در این مطلب، ویدئو بوت استرپینگ یادگیری ماشینی، آمار با استفاده از Numpy و Statsmodel در پایتون با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:07:40

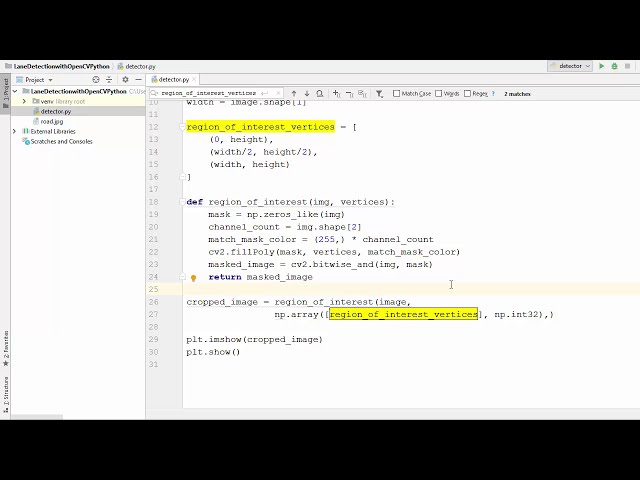

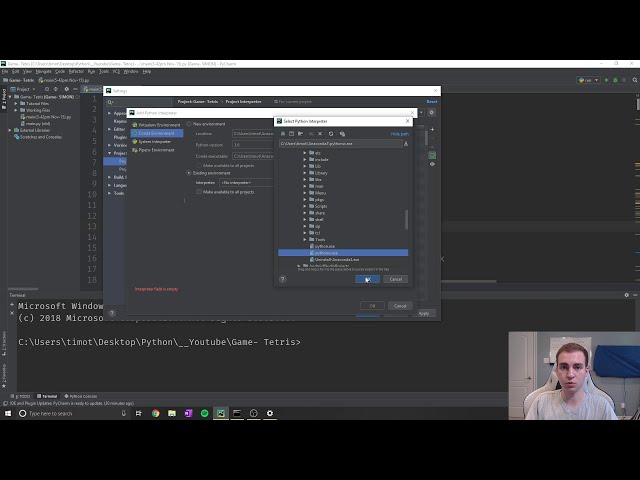

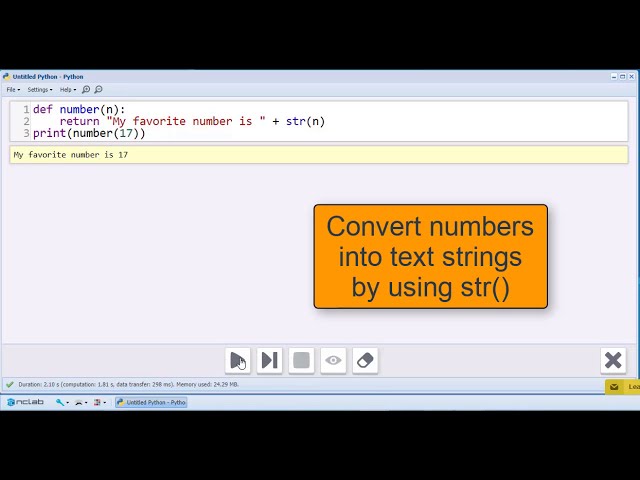

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,030 –> 00:00:04,040

اکنون یک سال پس از انتخاب مایا گرین،

2

00:00:04,040 –> 00:00:06,600

او یک سری اصلاحات بسیار

3

00:00:06,600 –> 00:00:09,870

بحث برانگیز را آغاز می کند.

4

00:00:09,870 –> 00:00:12,360

5

00:00:12,360 –> 00:00:16,410

6

00:00:16,410 –> 00:00:19,529

7

00:00:19,529 –> 00:00:23,460

زمانی که

8

00:00:23,460 –> 00:00:25,650

از افرادی که مصاحبه

9

00:00:25,650 –> 00:00:28,760

می کنید بخواهید نمره ای بین 0 تا

10

00:00:28,760 –> 00:00:31,920

10 به آنها بدهند، احساس تنبلی می کنید، بنابراین فقط صد نمونه می گیرید،

11

00:00:31,920 –> 00:00:35,790

سپس بسته ها را وارد می کنیم

12

00:00:35,790 –> 00:00:46,980

و داده ها را بارگذاری می کنیم، به نظر می رسد شهروند

13

00:00:46,980 –> 00:00:49,550

با دقت زیادی به شما نمره داده است،

14

00:00:49,550 –> 00:00:53,879

ما در اشتباه هستیم. با این کار،

15

00:00:53,879 –> 00:00:56,210

16

00:01:05,170 –> 00:01:08,000

نمونه خود را با آمار خلاصه به هیستوگرام و اسکریپت نگاه می کنیم

17

00:01:08,000 –> 00:01:10,850

، هیستوگرام

18

00:01:10,850 –> 00:01:14,090

هیچ شکل ساده قابل تشخیصی ندارد، اما

19

00:01:14,090 –> 00:01:18,350

میانگین نمونه 5.5 است، چه می توانیم

20

00:01:18,350 –> 00:01:21,709

در مورد میانگین واقعی بگوییم که این بار

21

00:01:21,709 –> 00:01:24,319

نمی توانیم فاصله اطمینان ایجاد کنیم.

22

00:01:24,319 –> 00:01:26,420

شبیه سازی توزیع plink یکسان

23

00:01:26,420 –> 00:01:29,390

زیرا نمی دانیم چگونه

24

00:01:29,390 –> 00:01:33,170

آن را توصیف کنیم و در واقع با توجه به برنامه مشاهده شده

25

00:01:33,170 –> 00:01:36,349

، بعید است که

26

00:01:36,349 –> 00:01:39,110

شکل ساده ای مانند توزیع بدون مقدار داشته

27

00:01:39,110 –> 00:01:42,920

باشد. با این حال، ما هنوز هم میتوانیم از

28

00:01:42,920 –> 00:01:46,069

محاسبات با استفاده از ایدهای قدرتمند در

29

00:01:46,069 –> 00:01:50,390

خراش دادن چکمههای آماری مدرن استفاده کنیم که

30

00:01:50,390 –> 00:01:55,340

توسط افرون در سال 1979 معرفی شد، بنابراین کاری که

31

00:01:55,340 –> 00:01:57,560

ما انجام خواهیم داد این است

32

00:01:57,560 –> 00:02:01,549

که با

33

00:02:01,549 –> 00:02:03,679

تولید یک خانواده بزرگ از نمونهها

34

00:02:03,679 –> 00:02:06,700

از نمونهای که داریم، عدم قطعیت آمار خود را به طور میانگین تخمین بزنیم. سپس

35

00:02:06,700 –> 00:02:08,929

مشخص کردن توزیع

36

00:02:08,929 –> 00:02:12,410

میانگین یا این خانواده، هر نمونه در

37

00:02:12,410 –> 00:02:16,010

خانواده آماده می شود، زیرا ما به

38

00:02:16,010 –> 00:02:18,980

طور تصادفی برای نمونه موجود خود نمرات می گیریم که

39

00:02:18,980 –> 00:02:21,590

اجازه می دهد همان نمره بیش از یک بار ترسیم شود

40

00:02:21,590 –> 00:02:22,370

41

00:02:22,370 –> 00:02:25,459

و از نظر فنی، ما

42

00:02:25,459 –> 00:02:28,340

با جایگزینی نمونه برداری می کنیم.

43

00:02:28,340 –> 00:02:31,190

سعی کنید آن را به یکباره انجام دهید، روش 11 پاندا

44

00:02:31,190 –> 00:02:33,980

ساده است بیش از 100 از فریم داده ها

45

00:02:33,980 –> 00:02:37,340

با جایگزینی ظاهر می شود، می بینیم که

46

00:02:37,340 –> 00:02:40,099

برای این نمونه گام خوب، میانگین

47

00:02:40,099 –> 00:02:41,150

کمی تفاوت است،

48

00:02:41,150 –> 00:02:43,519

بنابراین بیایید توزیع نوار بوت

49

00:02:43,519 –> 00:02:46,790

معنی را انجام دهیم که یک

50

00:02:46,790 –> 00:02:50,450

مرحله بوت ساده ایجاد می کنیم. این پرتو را

51

00:02:50,450 –> 00:02:53,120

با استفاده از درک لیست پایتون 1000

52

00:02:53,120 –> 00:02:56,329

بار تکرار کنید و سپس آن را در

53

00:02:56,329 –> 00:02:59,500

فریم داده خود

54

00:03:03,500 –> 00:03:06,209

تا کنید و متغیر میانگین را بریل صدا می کنیم.

55

00:03:06,209 –> 00:03:09,180

و همه چیز را مستقیماً در تابلوی قاب داده ذخیره کنید،

56

00:03:09,180 –> 00:03:17,269

بیایید یک هیستوگرام بگیریم،

57

00:03:18,319 –> 00:03:21,810

به خاطر داشته