در این مطلب، ویدئو مقدمه – یادگیری عمیق و شبکه های عصبی با پایتون و پایتورچ p.1 با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:24:49

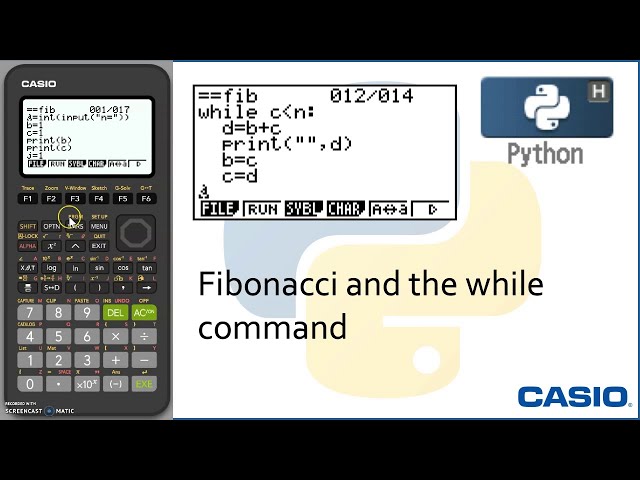

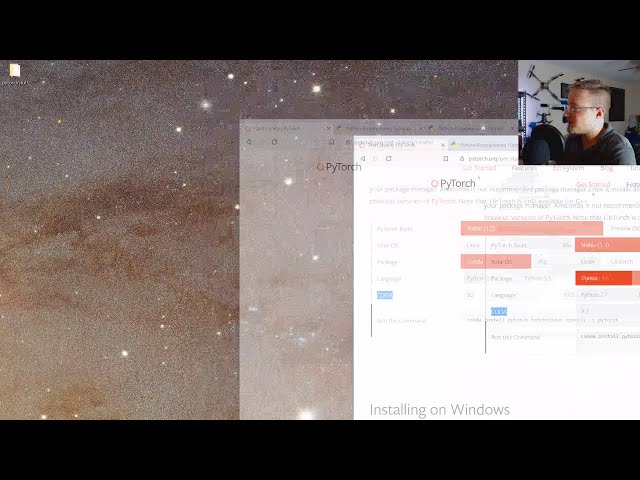

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,829 –> 00:00:03,629

چه خبر است و

2

00:00:03,629 –> 00:00:06,540

به یادگیری عمیق با پایتون و

3

00:00:06,540 –> 00:00:09,000

مجموعه آموزش مشعل کاج خوش آمدید، این

4

00:00:09,000 –> 00:00:10,530

مجموعه آموزشی

5

00:00:10,530 –> 00:00:12,360

با فرض اینکه شاید شما

6

00:00:12,360 –> 00:00:13,950

چیزی در مورد یادگیری عمیق ندانید

7

00:00:13,950 –> 00:00:15,299

و سپس به موارد بیشتری وارد خواهیم شد، از ابتدا شروع می شود

8

00:00:15,299 –> 00:00:17,940

انواع پیچیده شبکههای عصبی و

9

00:00:17,940 –> 00:00:21,000

برنامههای کاربردی برای آنها، بنابراین به هر حال

10

00:00:21,000 –> 00:00:22,590

برای شروع، شما به

11

00:00:22,590 –> 00:00:24,689

مشعل pide نیاز دارید، همچنین به پایتون نیاز خواهید

12

00:00:24,689 –> 00:00:27,900

13

00:00:27,900 –> 00:00:30,000

14

00:00:30,000 –> 00:00:32,640

داشت. اصول اولیه پایتون و

15

00:00:32,640 –> 00:00:35,850

همچنین برنامه نویسی شی گرا، بنابراین

16

00:00:35,850 –> 00:00:37,430

اگر هیچ یک از این دو مورد را

17

00:00:37,430 –> 00:00:41,160

ندارید، احتمالاً باید متوقف شوید و یا

18

00:00:41,160 –> 00:00:42,780

آموزش های شخص دیگری را پیدا کنید یا من

19

00:00:42,780 –> 00:00:44,910

آموزش هایی در مورد هر دو پایه دارم، این یک

20

00:00:44,910 –> 00:00:47,280

سری بسیار کوتاه است، مانند 13 قطعات

21

00:00:47,280 –> 00:00:50,660

یا چیزی شبیه به آن و سپس

22

00:00:50,660 –> 00:00:53,190

دوباره برنامه نویسی شی گرا،

23

00:00:53,190 –> 00:00:56,010

ویدیوهای زیادی نیست که

24

00:00:56,010 –> 00:00:59,570

بتوانید خیلی سریع از آن عبور کنید،

25

00:00:59,570 –> 00:01:01,500

باید درک اولیه ای از

26

00:01:01,500 –> 00:01:03,210

Python داشته باشید. چون من فقط فرض میکنم که شما این کار را انجام میدهید،

27

00:01:03,210 –> 00:01:04,890

من در مورد مفاهیم پایه پایتون صحبت نمیکنم

28

00:01:04,890 –> 00:01:07,590

و سپس ایراد یا در

29

00:01:07,590 –> 00:01:09,360

برنامهنویسی خود را مطرح نمیکنم، زیرا به طور کلی

30

00:01:09,360 –> 00:01:12,150

شبکه عادی شما یک کلاس است، بنابراین

31

00:01:12,150 –> 00:01:13,619

اگر متوجه نشدید که میخواهید

32

00:01:13,619 –> 00:01:15,509

در مورد برخی چیزها مبهم باشید و

33

00:01:15,509 –> 00:01:17,369

سپس احتمالاً در مورد شبکه های عصبی نیز مبهم هستید،

34

00:01:17,369 –> 00:01:18,960

این ترکیب خوبی نیست، ابتدا

35

00:01:18,960 –> 00:01:19,680

36

00:01:19,680 –> 00:01:21,270

باید در مورد نحوه عملکرد

37

00:01:21,270 –> 00:01:23,250

برنامه نویسی شی گرا کاملاً مطمئن باشید

38

00:01:23,250 –> 00:01:28,590

و سپس به این مرحله بعدی بروید،

39

00:01:28,590 –> 00:01:30,990

فرض می کنم شما بچه ها این کار را نمی کنید حداقل برخی از

40

00:01:30,990 –> 00:01:32,430

شما احتمالاً در مورد

41

00:01:32,430 –> 00:01:33,990

شبکههای عصبی نمیدانید یا حداقل چیز

42

00:01:33,990 –> 00:01:35,850

زیادی نمیدانید، بنابراین من واقعاً

43

00:01:35,850 –> 00:01:37,619

به طور خلاصه به نحوه عملکرد شبکههای عصبی

44

00:01:37,619 –> 00:01:40,970

میپردازم که میتوانید با

45

00:01:40,970 –> 00:01:43,530

درک سطح بالایی از شبکههای عصبی از اینجا بگذرید.

46

00:01:43,530 –> 00:01:45,720

شبکه ها و خوب باشید و

47

00:01:45,720 –> 00:01:47,340

اگر می خواهید بسیار موفق

48

00:01:47,340 –> 00:01:48,600

باشید

49

00:01:48,600 –> 00:01:51,000

، حداقل برای این مجموعه به درک عمیقی نیاز

50

00:01:51,000 –> 00:01:52,560

خواهید داشت، ما خیلی سریع به آن عمیق نمی شویم

51

00:01:52,560 –> 00:01:54,990

زیرا باز هم شما واقعاً

52

00:01:54,990 –> 00:01:57,149

به آن نیاز ندارید. اما اگر کنجکاو هستید یا

53

00:01:57,149 –> 00:01:58,670

میخواهید وارد

54

00:01:58,670 –> 00:02:00,840

تحقیقات پیشرفتهتر و مواردی از این دست شوید،

55

00:02:00,840 –> 00:02:03,570

بنابراین با پیشرفت این مجموعه

56

00:02:03,570 –> 00:02:05,009

، کمی

57

00:02:05,009 –> 00:02:07,079

عمیقتر به موضوعات میپردازیم، اما سپس

58

00:02:07,079 –> 00:02:08,399

درباره مفاهیم صحبت خواهیم کرد، بنابراین من

59

00:02:08,399 –> 00:02:10,649

من نمیخواهم فوراً ضربه بزنم زیرا

60

00:02:10,649 –> 00:02:12,879

نیازی نیست

61

00:02:12,879 –> 00:02:14,530

و سپس در برخی مواقع میخواهم

62

00:02:14,530 –> 00:02:16,480

در شبکههای عصبی از ابتدا ویدیو انجام

63

00:02:16,480 –> 00:02:17,920

دهم و منظورم این است که از numpy استفاده

64

00:02:17,920 –> 00:02:20,439

میکنیم، ما به کاری مانند

65

00:02:20,439 –> 00:02:21,969

ریاضی آرایه یا چیزی دیگر نیاز داریم. اینطور است اما هیچ

66

00:02:21,969 –> 00:02:25,480

کمکی کار نمی کند فقط به این دلیل که لیست

67

00:02:25,480 –> 00:02:26,859

واقعاً کند است به هر حال

68

00:02:26,859 –> 00:02:28,480

مهم نیست، اما اگر می خواهید

69

00:02:28,480 –> 00:02:30,430

کمی عمیق تر شوید، می توانید

70

00:02:30,430 –> 00:02:33,569

هم در این سری و هم در آینده به

71

00:02:33,569 –> 00:02:35,680

هر حال با فرض اینکه چیزی نمی دانید

72

00:02:35,680 –> 00:02:36,730

در مورد شبکه های عصبی،

73

00:02:36,730 –> 00:02:38,290

من به طور خلاصه به آنها می پردازم، اما

74

00:02:38,290 –> 00:02:39,669

دوباره اگر هنوز

75

00:02:39,669 –> 00:02:41,889

در مورد نحوه عملکرد

76

00:02:41,889 –> 00:02:43,989

شبکه های عصبی تا حدی مبهم هستید، می توانید ویدیوها را با

77

00:02:43,989 –> 00:02:46,450

سه رنگ آبی یک قهوه ای جستجو کنید که

78

00:02:46,450 –> 00:02:49,030

تصاویر بصری فوق العاده ای در آنجا وجود دارد.

79

00:02:49,030 –> 00:02:50,709

اطلاعات بسیار تا آنجایی

80

00:02:50,709 –> 00:02:52,359

که شبکههای عصبی در سطح پایه چگونه کار میکنند،

81

00:02:52,359 –> 00:02:54,069

من تمام تلاشم را میکنم تا

82

00:02:54,069 –> 00:02:57,879

آنها را خیلی سریع توضیح دهم، بنابراین این یک

83

00:02:57,879 –> 00:02:59,439

شبکه عصبی اولیه است، شما دادههای ورودی خود را

84

00:02:59,439 –> 00:03:01,750

در اینجا دریافت کردهاید و فرض کنید یک

85

00:03:01,750 –> 00:03:04,359

Nisshin دارید. در جایی که سعی می کنید

86

00:03:04,359 –> 00:03:10,239

تصاویری از سگ گربه و انسان دارید و

87

00:03:10,239 –> 00:03:12,099

یک شبکه عصبی می خواهید که

88

00:03:12,099 –> 00:03:14,349

بتواند بین تصویر سگ

89

00:03:14,349 –> 00:03:18,459

گربه و انسان تمایز قائل شود، بنابراین در اینجا در

90

00:03:18,459 –> 00:03:20,739

ورودی خود ویژگی هایی دارید و

91

00:03:20,739 –> 00:03:23,590

اینها باید به نحوی عددی ارزش گذاری

92

00:03:23,590 –> 00:03:26,139

شود، ممکن است این مورد به این صورت باشد که

93

00:03:26,139 –> 00:03:27,790

آنها مقادیر پیکسل هستند و مقادیر پیکسل

94

00:03:27,790 –> 00:03:30,579

قبلاً مقادیر عددی درست از 0 تا

95

00:03:30,579 –> 00:03:33,699

255 برای RGB هستند یا اگر تصویر با مقیاس خاکستری

96

00:03:33,699 –> 00:03:36,430

است فقط 0 تا 255 یا یک

97

00:03:36,430 –> 00:03:38,259

عدد دیگر است که معمولاً از 0 تا 255 به

98

00:03:38,259 –> 00:03:42,099

هر حال، بنابراین آنها قبلاً به

99

00:03:42,099 –> 00:03:44,560

شکل عددی خواهند بود، اما ویژگیهای شما

100

00:03:44,560 –> 00:03:47,109

نیز میتواند به گونهای باشد که ورودی ما

101

00:03:47,109 –> 00:03:51,099

102

00:03:51,099 –> 00:03:53,409

103

00:03:53,409 –> 00:03:57,129

آن ویژگیها را مینامیم.

104

00:03:57,129 –> 00:04:01,750

بدن پوشیده از مو یا

105

00:04:01,750 –> 00:04:03,129

برخی چیزی شبیه به آن یا چه

106

00:04:03,129 –> 00:04:06,459

نوع رنگی است این چیز چقدر بلند است که این چیزها

107

00:04:06,459 –> 00:04:08,409

مانند

108

00:04:08,409 –> 00:04:09,969

ویژگی های توصیفی هستند و در برخی مواقع باید

109

00:04:09,969 –> 00:04:12,759

آن را به عدد تبدیل کنیم تا بتوانید

110

00:04:12,759 –> 00:04:16,269

مانند یک لایک انجام دهید فقط

111

00:04:16,269 –> 00:04:17,858

اولین چیزی که 0 است دومین

112

00:04:17,858 –> 00:04:19,418

مورد 1 و غیره است و ما در

113

00:04:19,418 –> 00:04:21,548

مورد آن و نحوه تبدیل

114

00:04:21,548 –> 00:04:24,099

چیزها به اعداد بعداً بیشتر صحبت خواهیم کرد، اما فقط

115

00:04:24,099 –> 00:04:25,419

درک کنید که همیشه یک

116

00:04:25,419 –> 00:04:26,020

عدد

117

00:04:26,020 –> 00:04:27,550

است که وارد می شود، باید یک

118

00:04:27,550 –> 00:04:30,370

عدد باشد، بنابراین به هر حال این ورودی شماست، بنابراین

119

00:04:30,370 –> 00:04:32,020

بیایید مقادیر پیکسل آنها را فرض کنیم زیرا

120

00:04:32,020 –> 00:04:36,550

این یک کار بسیار رایج است، بنابراین و

121

00:04:36,550 –> 00:04:39,580

مقیاس بندی آن عالی است، فرض کنید این

122

00:04:39,580 –> 00:04:41,349

ورودی را دارید و سپس به این چیزهایی که لایه های مخفی نامیده می شوند منتقل می شود،

123

00:04:41,349 –> 00:04:42,099

124

00:04:42,099 –> 00:04:43,780

آنها پنهان نامیده می شوند

125

00:04:43,780 –> 00:04:45,580

زیرا ما کنترل نداریم. روی آن

126

00:04:45,580 –> 00:04:47,470

لایهها، ماشین روی آن لایهها کنترل دارد،

127

00:04:47,470 –> 00:04:49,960

ما میتوانیم آنها را بخوانیم، میتوانیم ببینیم

128

00:04:49,960 –> 00:04:52,240

چه اتفاقی میافتد، اما ما

129

00:04:52,240 –> 00:04:55,090

هیچ مقداری را در آنجا تغییر نمیدهیم، بعد از اینکه از

130

00:04:55,090 –> 00:04:56,830

لایههای مخفی عبور کردند، آنها به یک

131

00:04:56,830 –> 00:04:59,620

خروجی منتقل میشوند و دوباره به طور کلی من فقط

132

00:04:59,620 –> 00:05:01,509

فوق العاده مبهم هستند،

133

00:05:01,509 –> 00:05:03,909

مبهم نیستند، اما امیدوارم هیچ چیز فوق العاده ای

134

00:05:03,909 –> 00:05:06,130

در اینجا وجود نداشته باشد، اجازه دهید فقط بگوییم این نورون، این نورون

135

00:05:06,130 –> 00:05:08,199

سگ شما

136

00:05:08,199 –> 00:05:10,630

است، این نورون گربه شما است، این نورون انسانی شما است

137

00:05:10,630 –> 00:05:13,419

و مقداری که در اینجا به

138

00:05:13,419 –> 00:05:16,150

طور کلی می رسد، ما یک Arg max انجام می دهیم. تابعی که

139

00:05:16,150 –> 00:05:17,740

فقط میخواهد بپرسد کدام یک از اینها

140

00:05:17,740 –> 00:05:20,080

بزرگتر است، بنابراین سگها، گربهها انسانها، بیایید بگوییم

141

00:05:20,080 –> 00:05:23,319

سگ پنج گربه است، هفت انسان،

142

00:05:23,319 –> 00:05:25,630

دوازده درست است، به این معنی است که

143

00:05:25,630 –> 00:05:28,150

بزرگترین ارزش انسان است، بنابراین ما میگوییم

144

00:05:28,150 –> 00:05:30,310

این شبکه عصبی پیشبینی کرده است که

145

00:05:30,310 –> 00:05:35,830

انسان مشکلی ندارد. بنابراین چگونه ماشین یک

146

00:05:35,830 –> 00:05:38,469

شبکه عصبی دارد حتی یاد میگیرد که

147

00:05:38,469 –> 00:05:40,780

اصلاً پیچیده نیست، ما میتوانیم به

148

00:05:40,780 –> 00:05:43,449

تصاویر واقعاً پیچیده مانند این نگاه کنیم، این است که شما

149

00:05:43,449 –> 00:05:44,740

حتی واقعاً مجبور نیستید به

150

00:05:44,740 –> 00:05:47,080

این روش فکر کنید، اما اساساً هر یک از این

151

00:05:47,080 –> 00:05:48,610

اتصالات میتوانید ببینید که چگونه وجود دارد. یک

152

00:05:48,610 –> 00:05:51,130

خط از هر ورودی به هر

153

00:05:51,130 –> 00:05:53,080

نورون در اینجا کشیده می شود و سپس هر نورون در اینجا

154

00:05:53,080 –> 00:05:54,520

با هر نورون دیگری ارتباط دارد

155

00:05:54,520 –> 00:05:56,560

درست همانطور که در اینجا به جلو ادامه می دهید

156

00:05:56,560 –> 00:05:59,110

این همان چیزی است که به عنوان یک

157

00:05:59,110 –> 00:06:02,710

نورون کاملا متصل شناخته می شود. شبکه l لازم

158

00:06:02,710 –> 00:06:04,300

نیست کاملاً متصل باشند و بعداً میتوانیم

159

00:06:04,300 –> 00:06:05,949

درباره نحوه انجام کارهای مختلف بیشتر صحبت کنیم،

160

00:06:05,949 –> 00:06:08,199

اما به طور کلی این یکی

161

00:06:08,199 –> 00:06:12,039

کاملاً متصل است و هر خط در اینجا هر

162

00:06:12,039 –> 00:06:15,940

اتصال واقعاً یک وزن است، بنابراین

163

00:06:15,940 –> 00:06:18,370

شما این مقدار ورودی را دارید و سپس در

164

00:06:18,370 –> 00:06:21,280

یک وزن ضرب می شود، یک بایاس به

165

00:06:21,280 –> 00:06:23,949

صورت اختیاری اضافه می شود و یک بایاس فقط

166

00:06:23,949 –> 00:06:26,830

یک اضافی است، می دانید که بایاس می تواند سه باشد،

167

00:06:26,830 –> 00:06:29,169

بنابراین شما می دانید که ضربات ورودی به

168

00:06:29,169 –> 00:06:31,900

اضافه سه خوب است و سپس در اینجا به یک مقدار تبدیل می شود

169

00:06:31,900 –> 00:06:34,479

و سپس x2 می شود. همان

170

00:06:34,479 –> 00:06:37,000

کار انجام می شود و همه اینها

171

00:06:37,000 –> 00:06:39,510

با هم در این یک نورون جمع می شوند، بنابراین

172

00:06:39,510 –> 00:06:40,980

من یک تصویر دیگر در اینجا دارم و مانند

173

00:06:40,980 –> 00:06:43,740

این است که اساساً چیزی است که در یک نورون منفرد می گذرد،

174

00:06:43,740 –> 00:06:45,540

بنابراین شما باید تمام

175

00:06:45,540 –> 00:06:47,520

ورودی های خود را در آن ورودی ها دریافت کنید.

176

00:06:47,520 –> 00:06:49,950

ضرب در وزن سوگیریهایی که

177

00:06:49,950 –> 00:06:53,310

احتمالاً اضافه میشوند، همه آنها

178

00:06:53,310 –> 00:06:54,960

با هم جمع میشوند، بنابراین فقط با هم جمع میشوند

179

00:06:54,960 –> 00:06:57,720

و از یک تابع فعالسازی عبور میکنند،

180

00:06:57,720 –> 00:07:00,180

بنابراین عملکرد فعالسازی به

181

00:07:00,180 –> 00:07:02,070

نوعی شبیه یک نورون در مغز شما

182

00:07:02,070 –> 00:07:03,810

میشود که شلیک میکند یا نیست. آن

183

00:07:03,810 –> 00:07:06,870

و این می تواند شلیک باشد یا نیست، بنابراین

184

00:07:06,870 –> 00:07:08,850

مانند یک تابع پله ای است، اما

185

00:07:08,850 –> 00:07:10,860

در بیشتر موارد ما از یک تابع سیگموئید استفاده می کنیم،

186

00:07:10,860 –> 00:07:12,900

بنابراین در واقع محدوده ای بین صفر

187

00:07:12,900 –> 00:07:15,990

و یک است، که باز هم به

188

00:07:15,990 –> 00:07:18,900

نوعی تقلید از شلیک نورون است یا نه و

189

00:07:18,900 –> 00:07:20,190

همچنین هدف آن این است که

190

00:07:20,190 –> 00:07:22,080

مقادیر فقط در

191

00:07:22,080 –> 00:07:24,240

شبکه عصبی شما منفجر نشوند، بلکه

192

00:07:24,240 –> 00:07:27,270

چیزها را دوباره بین صفر و یک نگه می دارد یکی از

193

00:07:27,270 –> 00:07:29,130

مفاهیم کلیدی که

194

00:07:29,130 –> 00:07:31,230

مرتباً مطرح می شود این است که به

195

00:07:31,230 –> 00:07:33,030

طور کلی شبکه های معمولی

196

00:07:33,030 –> 00:07:35,460

ارزش ها را ارزیابی می کنند. بین صفر و یک یا منفی

197

00:07:35,460 –> 00:07:38,850

یک و یک در برخی موارد، بنابراین همیشه

198

00:07:38,850 –> 00:07:40,320

این را در نظر داشته باشید تا ورودی شما معمولاً

199

00:07:40,320 –> 00:07:42,060

کاری به نام مقیاسبندی انجام میدهید

200

00:07:42,060 –> 00:07:45,510

و آن را بین صفر و

201

00:07:45,510 –> 00:07:47,190

یک کاهش میدهید و سپس بله، حتی از طریق

202

00:07:47,190 –> 00:07:49,620

شبکهتان پس از شروع مقادیر منفجر شدن در

203

00:07:49,620 –> 00:07:51,690

این مقادیر غول پیکر

204

00:07:51,690 –> 00:07:54,360

احتمالاً چیزی اشتباه پیش می رود، اما بیشتر از

205

00:07:54,360 –> 00:07:57,000

آن بعداً تنها چیزی که باید

206

00:07:57,000 –> 00:07:59,700

واقعاً به آن فکر کنید این است که یک

207

00:07:59,700 –> 00:08:02,790

شبکه عصبی چه کاری انجام می دهد این است که هر یک از

208

00:08:02,790 –> 00:08:04,710

این وزن ها همان چیزی است که ما محاسبه می کنیم.

209

00:08:04,710 –> 00:08:06,930

پارامتری که با بایاسها

210

00:08:06,930 –> 00:08:09,600

و وزنها و بایاسها مشابه است، حتی این

211

00:08:09,600 –> 00:08:11,070

شبکه عصبی واقعاً ساده که من به تازگی

212

00:08:11,070 –> 00:08:14,790

ترسیم کردهام، به تمام آن پارامترها نگاه کنید که

213

00:08:14,790 –> 00:08:17,580

هر خط وجود دارد، یک

214

00:08:17,580 –> 00:08:20,340

پارامتر است که احتمالاً دو پارامتر است

215

00:08:20,340 –> 00:08:23,760

اگر وزنها و بایاسها را در نظر بگیریم.

216

00:08:23,760 –> 00:08:26,070

ماشین این کار را انجام می دهد این است که این

217

00:08:26,070 –> 00:08:29,190

توانایی را دارد که هر یک از

218

00:08:29,190 –> 00:08:32,190

آن وزن ها را به طور مستقل تغییر دهد،

219

00:08:32,190 –> 00:08:34,710

بنابراین تمام آنها را به گونه ای تنظیم می

220

00:08:34,710 –> 00:08:37,470

کند که وقتی داده ها را هنگام آموزش شبکه عصبی ارسال

221

00:08:37,470 –> 00:08:39,539

می کنیم، این داده های ورودی را ارسال می کنیم

222

00:08:39,539 –> 00:08:42,030

و ما به آن می گوییم بیایید بگوییم

223

00:08:42,030 –> 00:08:44,010

واقعاً تصویری از یک انسان است، ما می گوییم

224

00:08:44,010 –> 00:08:46,770

خروجی مورد نظر خروجی ای که ای کاش

225

00:08:46,770 –> 00:08:48,870

در این مورد ایجاد می کردید صفر صفر

226

00:08:48,870 –> 00:08:51,840

است درست است لطفاً آن را بسازید و خروجی خود را ایجاد می

227

00:08:51,840 –> 00:08:53,370

کند

228

00:08:53,370 –> 00:08:55,110

و سپس تعیین می کنیم که چگونه اشتباه است که

229

00:08:55,110 –> 00:08:58,380

با از دست دادن است و سپس ما یک بهینه ساز داریم

230

00:08:58,380 –> 00:09:00,810

که به عقب برمی گردد و سعی می کند

231

00:09:00,810 –> 00:09:03,750

این وزن ها را به گونه ای به روز کند که

232

00:09:03,750 –> 00:09:08,160

به پیش بینی خروجی هدف نزدیک تر شود

233

00:09:08,160 –> 00:09:11,300

و ما تمایل داریم این کار را روی دسته های بیش از

234

00:09:11,300 –> 00:09:15,089

میلیون ها انجام دهیم. نمونهها و به آرامی در طول زمان

235

00:09:15,089 –> 00:09:17,130

شبکه عصبی یاد میگیرد که چه

236

00:09:17,130 –> 00:09:18,990

مقادیر دقیقی برای هر یک از این وزنها قرار دهد

237

00:09:18,990 –> 00:09:22,020

تا امیدواریم دادههای شما را تعمیم داده

238

00:09:22,020 –> 00:09:24,630

و پیشبینی کند، اما در پایان

239

00:09:24,630 –> 00:09:26,910

روز مانند این تابع غولپیکر

240

00:09:26,910 –> 00:09:30,480

با حدود یک میلیون متغیر است که گاهی

241

00:09:30,480 –> 00:09:32,460

اوقات شبیه شما بیشتر است. مثل اینکه

242

00:09:32,460 –> 00:09:34,770

من اصلا نیستم، اغراق نمیکنم، مثل اینکه سه میلیون

243

00:09:34,770 –> 00:09:36,930

متغیر یک شبکه عصبی بسیار کوچک

244

00:09:36,930 –> 00:09:40,170

245

00:09:40,170 –> 00:09:42,510

246

00:09:42,510 –> 00:09:44,760

247

00:09:44,760 –> 00:09:46,710

248

00:09:46,710 –> 00:09:48,870

است. مانند نصب بیش از حد و مواردی از این

249

00:09:48,870 –> 00:09:51,900

قبیل و ما در مورد حرکت

250

00:09:51,900 –> 00:09:54,180

رو به جلو صحبت خواهیم کرد، اما در واقع تمام چیزی که یک شبکه

251

00:09:54,180 –> 00:09:56,580

عصبی است فقط این عملکرد بزرگ است که در آن

252

00:09:56,580 –> 00:09:58,770

به ماشین اجازه می دهیم تا به آرامی

253

00:09:58,770 –> 00:10:01,500

متغیرها و پارامترها را تغییر دهد تا

254

00:10:01,500 –> 00:10:03,870

نتایج مطلوب را به دست آورد، بنابراین اکنون امیدواریم

255

00:10:03,870 –> 00:10:06,630

که یک کلیات و

256

00:10:06,630 –> 00:10:07,980

درک اولیه از نحوه کار دوباره شبکه های عصبی

257

00:10:07,980 –> 00:10:10,200

من فکر می کنم کاملاً

258

00:10:10,200 –> 00:10:12,029

قابل انتظار است که شما در مورد نحوه کار کردن چیزها تا حدودی مبهم هستید.

259

00:10:12,029 –> 00:10:14,640

260

00:10:14,640 –> 00:10:16,620

این به صورت کد به شما کمک می کند،

261

00:10:16,620 –> 00:10:19,260

اما منابع وسیعی به صورت آنلاین وجود

262

00:10:19,260 –> 00:10:21,029

دارد تا جایی که نحوه عملکرد شبکه های عصبی را به تصویر می کشد

263

00:10:21,029 –> 00:10:23,490

و اگر اینطوری یاد می گیرید، من

264

00:10:23,490 –> 00:10:25,170

اکیداً سه آبی یک

265

00:10:25,170 –> 00:10:27,089

قهوه ای را فقط نوع

266

00:10:27,089 –> 00:10:28,920

لایک را به شبکه عصبی سه آبی یک قهوه ای یوتیوب توصیه می کنم. و من

267

00:10:28,920 –> 00:10:30,900

مطمئن هستم که سریالی که او

268

00:10:30,900 –> 00:10:33,270

در تجسم فوق العاده است، بسیار بهتر

269

00:10:33,270 –> 00:10:36,150

از دستان من روی عکس ها خواهید یافت، بنابراین در هر

270

00:10:36,150 –> 00:10:39,240

حال ما از مشعل PI استفاده می کنیم، به

271

00:10:39,240 –> 00:10:41,220

احتمال زیاد شما

272

00:10:41,220 –> 00:10:43,170

مطمئناً در مورد جریان تانسور شنیده اید که یکی دیگر از این است.

273

00:10:43,170 –> 00:10:44,520

کتابخانه یادگیری ماشین و

274

00:10:44,520 –> 00:10:47,100

تعداد کمی دیگر وجود دارد که من می خواهم از مشعل PI استفاده

275

00:10:47,100 –> 00:10:49,260

کنم، یکی از آن ها تازه شروع کردم، فقط

276

00:10:49,260 –> 00:10:51,240

یک روز تصمیم گرفتم PI را با خودم یاد بگیرم و

277

00:10:51,240 –> 00:10:53,459

همانطور که داشتم آن را یاد می گرفتم،

278

00:10:53,459 –> 00:10:55,410

این یک زبان واقعاً خوب برای انجام یک کار بود.

279

00:10:55,410 –> 00:10:57,930

شما سری های یادگیری عمیق مبتدیان را می شناسید

280

00:10:57,930 –> 00:11:00,720

زیرا مشعل PI مانند

281

00:11:00,720 –> 00:11:02,030

282

00:11:02,030 –> 00:11:03,890

یک برنامه نویس پایتون

283

00:11:03,890 –> 00:11:06,200

در مقابل تنسورفلو بسیار دوستانه با گرامر است و از یک

284

00:11:06,200 –> 00:11:08,990

جهت با نمودار است و

285

00:11:08,990 –> 00:11:10,760

چیز عالی در مورد مشعل لوله این است که شما این کار را انجام نمی دهید.

286

00:11:10,760 –> 00:11:12,950

نیازی نیست بدانید که این نمودار

287

00:11:12,950 –> 00:11:14,540

چیست، چه چیزی در مورد آن صحبت

288

00:11:14,540 –> 00:11:16,430

289

00:11:16,430 –> 00:11:18,320

290

00:11:18,320 –> 00:11:19,970

291

00:11:19,970 –> 00:11:23,120

می کند. بسیار

292

00:11:23,120 –> 00:11:24,170

چالش برانگیز است

293

00:11:24,170 –> 00:11:26,270

در حالی که در مشعل PI شما

294

00:11:26,270 –> 00:11:28,220

واقعاً نیازی به دانستن در مورد آن ندارید و بنابراین و

295

00:11:28,220 –> 00:11:30,140

سپس مردم آن را مانند پایتونیک تر می نامند

296

00:11:30,140 –> 00:11:31,340

و دوست دارند که

297

00:11:31,340 –> 00:11:34,880

در واقع به طور کلی به چه معناست، مثلاً با

298

00:11:34,880 –> 00:11:36,920

مشعل PI برنامه نویسی پایتون را می نویسید همانطور

299

00:11:36,920 –> 00:11:39,410

که می نویسید شما با آن برخورد می کنید

300

00:11:39,410 –> 00:11:42,080

مانند یک شی که شما مشتاقانه

301

00:11:42,080 –> 00:11:44,980

اجرا می کنید و تانسورفلو مشتاق است

302

00:11:44,980 –> 00:11:48,080

اما جریان تانسور اصلی نیست و

303

00:11:48,080 –> 00:11:49,880

مسائل و محدودیت های خاصی در

304

00:11:49,880 –> 00:11:52,550

استفاده از آن وجود دارد همچنین بسیار کندتر از

305

00:11:52,550 –> 00:11:56,000

جریان تانسور معمولی است و سپس

306

00:11:56,000 –> 00:11:57,320

سوال بعدی البته

307

00:11:57,320 –> 00:11:59,380

مشعل پی در مقایسه با جریان و سرعت تانسور چگونه است

308

00:11:59,380 –> 00:12:02,810

و آنها در واقع بسیار نزدیک هستند، اما

309

00:12:02,810 –> 00:12:05,000

مشعل PI سریعتر از جریان تانسور مشتاق است

310

00:12:05,000 –> 00:12:06,770

و این مقایسه منصفانه تری خواهد بود

311

00:12:06,770 –> 00:12:08,540

زیرا مشعل PI مشتاق است. و

312

00:12:08,540 –> 00:12:10,580

منظور من از این چیست که منظورم این است که شما می

313

00:12:10,580 –>