در این مطلب، ویدئو شبکه های عصبی پایتون – آموزش Tensorflow 2.0 – ایجاد مدل با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:17:40

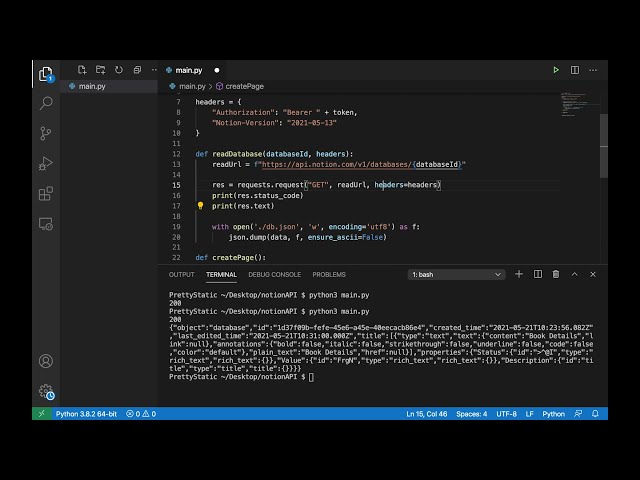

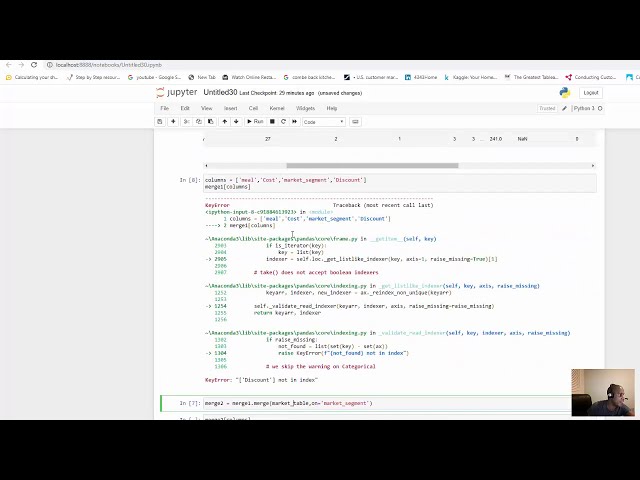

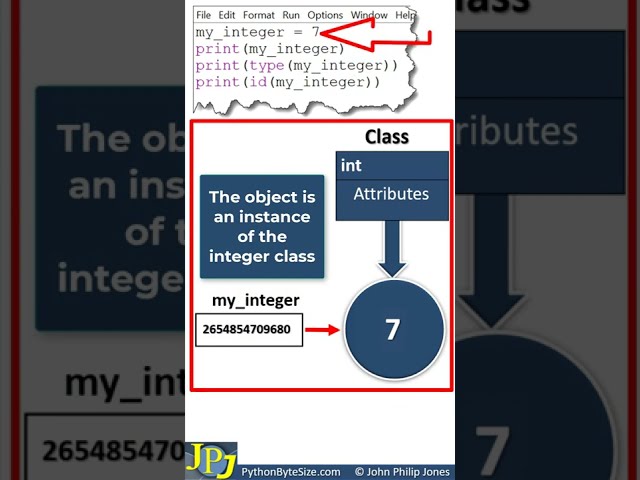

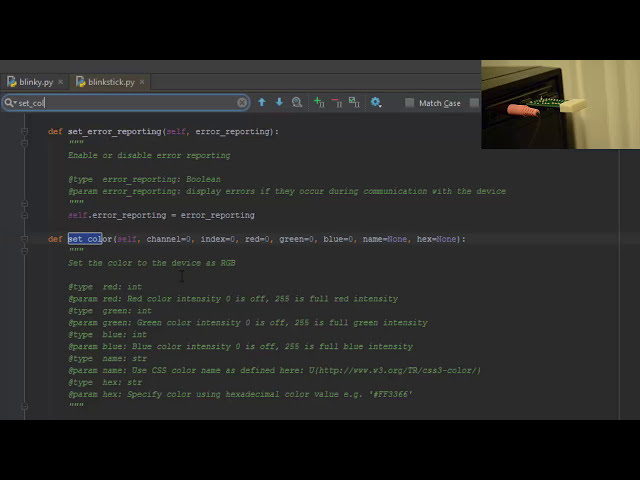

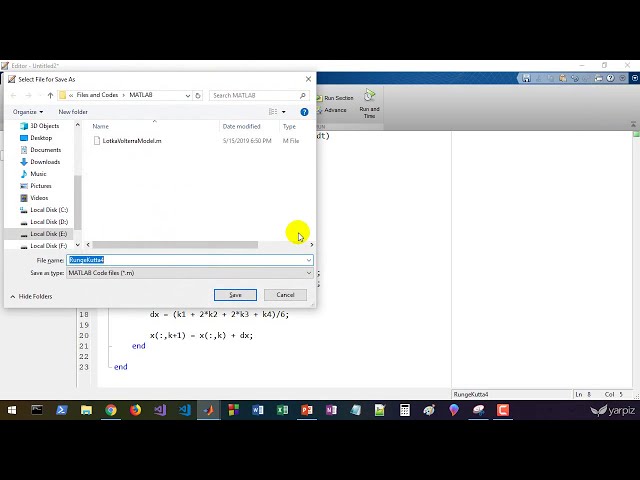

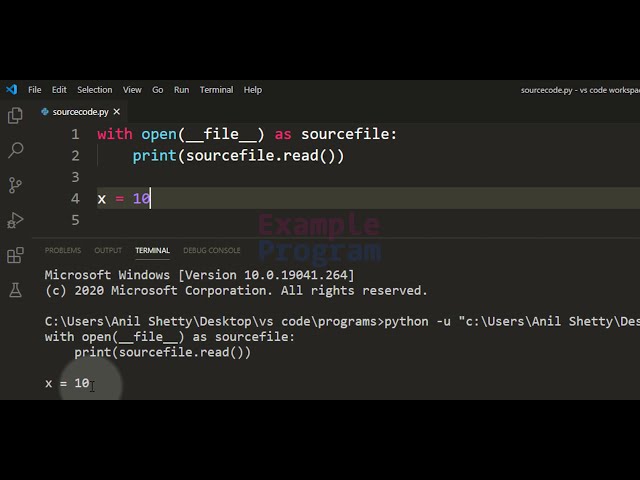

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,030 –> 00:00:02,190

سلام بچه ها و به سومین

2

00:00:02,190 –> 00:00:04,440

آموزش شبکه عصبی خوش آمدید اکنون در

3

00:00:04,440 –> 00:00:05,490

ویدیوی امروز ما در واقع

4

00:00:05,490 –> 00:00:07,470

با شبکه عصبی کار می کنیم بنابراین

5

00:00:07,470 –> 00:00:08,790

مدلی را راه اندازی می کنیم که در حال

6

00:00:08,790 –> 00:00:09,840

آموزش آن مدلی هستیم که می خواهیم

7

00:00:09,840 –> 00:00:11,730

آزمایش کنیم. این مدل برای اینکه ببینیم چقدر خوب

8

00:00:11,730 –> 00:00:13,950

عمل می کند، از آن برای پیش

9

00:00:13,950 –> 00:00:16,800

بینی تصاویر فردی و همه چیزهای سرگرم کننده نیز استفاده خواهیم

10

00:00:16,800 –> 00:00:19,050

کرد، بنابراین بدون هیچ مقدمه ای اجازه دهید

11

00:00:19,050 –> 00:00:19,680

12

00:00:19,680 –> 00:00:21,449

اکنون شروع کنیم اولین کاری که می خواهم

13

00:00:21,449 –> 00:00:22,800

قبل از اینکه واقعاً وارد

14

00:00:22,800 –> 00:00:24,449

نوشتن هر کدی شویم این است که در مورد

15

00:00:24,449 –> 00:00:26,369

معماری شبکه عصبی که اکنون می

16

00:00:26,369 –> 00:00:28,289

خواهیم ایجاد کنیم صحبت کنید من همیشه در

17

00:00:28,289 –> 00:00:29,760

آموزش ها می دیدم که آنها هرگز واقعاً

18

00:00:29,760 –> 00:00:32,189

توضیح ندادند که لایه ها دقیقاً چه

19

00:00:32,189 –> 00:00:34,469

کاری انجام می دهند به نظر می رسد و چرا ما

20

00:00:34,469 –> 00:00:36,420

چنین لایه هایی را انتخاب کرده ایم و این چیزی است که من امیدوار هستم.

21

00:00:36,420 –> 00:00:39,210

همین الان به شما بچه ها بدهم، بنابراین

22

00:00:39,210 –> 00:00:41,219

اگر قبلاً به خاطر داشته باشید، اکنون می دانیم

23

00:00:41,219 –> 00:00:43,500

که تصاویر ما اساساً به

24

00:00:43,500 –> 00:00:46,649

اندازه 28 در 28 پیکسل هستند و روشی که

25

00:00:46,649 –> 00:00:48,390

آنها را داریم این است که ما یک آرایه داریم و

26

00:00:48,390 –> 00:00:50,340

یک آرایه دیگر در داخل داریم که شبیه یک

27

00:00:50,340 –> 00:00:51,930

t است. آرایه بعدی wo و مقادیر پیکسل خانه،

28

00:00:51,930 –> 00:00:55,680

بنابراین ممکن است مانند 0.1 0.3 باشد که

29

00:00:55,680 –> 00:00:57,539

مقدار مقیاس خاکستری است و این می رود و

30

00:00:57,539 –> 00:01:00,859

بار 28 وجود دارد و هر ردیف از

31

00:01:00,859 –> 00:01:03,600

این پیکسل ها اکنون 28 ردیف وجود دارد،

32

00:01:03,600 –> 00:01:06,180

بدیهی است در حالی که 28 در 28 پیکسل است،

33

00:01:06,180 –> 00:01:08,880

بنابراین در اینجا دوباره ما این مقدار را داریم. همان چیزی که

34

00:01:08,880 –> 00:01:12,299

مقادیر پیکسل بیشتری دارد و ما 28

35

00:01:12,299 –> 00:01:14,159

برابر پایین میرویم و

36

00:01:14,159 –> 00:01:16,110

این چیزی است که داریم و آرایه ما به این شکل

37

00:01:16,110 –> 00:01:17,670

است که اکنون دادههای ورودی ما

38

00:01:17,670 –> 00:01:19,770

خوب است، اما این واقعاً

39

00:01:19,770 –> 00:01:22,020

برای شبکه عصبی ما خوب

40

00:01:22,020 –> 00:01:23,400

کار نمیکند. آیا قرار است یک نورون داشته

41

00:01:23,400 –> 00:01:24,900

باشیم و فقط کل این موضوع را

42

00:01:24,900 –> 00:01:26,820

به آن منتقل کنیم، من فکر نمیکنم که

43

00:01:26,820 –> 00:01:28,439

خیلی خوب کار کند، بنابراین

44

00:01:28,439 –> 00:01:30,689

قبل از شروع صحبت در مورد شبکه عصبی چه کاری باید انجام دهیم.

45

00:01:30,689 –> 00:01:31,950

46

00:01:31,950 –> 00:01:34,920

این است که راهی پیدا کنیم که بتوانیم

47

00:01:34,920 –> 00:01:36,780

این اطلاعات را به روشی تغییر دهیم که بتوانیم

48

00:01:36,780 –> 00:01:38,729

آن را به شبکه عصبی بدهیم، بنابراین کاری که

49

00:01:38,729 –> 00:01:41,100

من در واقع انجام خواهم داد و منظور من این است

50

00:01:41,100 –> 00:01:43,170

که بیشتر مردم انجام می دهند این است که آنها کاری انجام می دهند که

51

00:01:43,170 –> 00:01:45,119

داده ها را صاف می کنند، بنابراین در واقع

52

00:01:45,119 –> 00:01:46,979

شاید شاید ما میریم من حدود حتی زمانی

53

00:01:46,979 –> 00:01:48,570

که آن را پاک کردم به عقب برنگردید، اما صاف کردن داده ها

54

00:01:48,570 –> 00:01:50,880

اساساً شبیه به لیست داخلی است،

55

00:01:50,880 –> 00:01:52,200

بنابراین بیایید بگوییم که ما یک لیست شبیه به

56

00:01:52,200 –> 00:01:54,810

این داریم و دقیقاً دوست داریم همه آنها را

57

00:01:54,810 –> 00:01:57,780

با هم بکوبیم، به جای اینکه بگوییم

58

00:01:57,780 –> 00:02:00,600

این مانند 1 2 3 است اگر ما قرار بود

59

00:02:00,600 –> 00:02:03,540

این را صاف کنیم، کاری که انجام میدهیم این است که در حالی که

60

00:02:03,540 –> 00:02:06,540

همه این آرایهها یا فهرستهای داخلی یا

61

00:02:06,540 –> 00:02:07,649

هر چیز دیگری را که هست حذف میکنیم، بنابراین در نهایت

62

00:02:07,649 –> 00:02:10,770

به دادههایی میرسیم که به نظر میرسد 1 2 3 و

63

00:02:10,770 –> 00:02:11,360

64

00:02:11,360 –> 00:02:14,750

معلوم میشود که برای ما خوب کار میکند.

65

00:02:14,750 –> 00:02:16,250

در این مثال، ما فقط مانند یک

66

00:02:16,250 –> 00:02:18,590

عنصر در هر آرایه داشتیم، اما وقتی

67

00:02:18,590 –> 00:02:20,660

با 28 عنصر در هر

68

00:02:20,660 –> 00:02:21,200

69

00:02:21,200 –> 00:02:22,670

آرایه گوش دادن لیست متأسفانه سروکار داریم، آنها قابل تعویض هستند،

70

00:02:22,670 –> 00:02:25,400

فقط در صورتی که من همچنان بگویم که

71

00:02:25,400 –> 00:02:27,290

آنچه اساساً دارد همان چیزی است که

72

00:02:27,290 –> 00:02:32,750

در داده ها مسطح است، بنابراین ما به دست می آوریم. لیستی به طول 784

73

00:02:32,750 –> 00:02:34,640

و من معتقدم این به این دلیل است که

74

00:02:34,640 –> 00:02:36,800

منظور من این است که من این خانه را می شناسم زیرا 28

75

00:02:36,800 –> 00:02:40,400

ضربدر 28 برابر با 784 است، بنابراین وقتی آن

76

00:02:40,400 –> 00:02:43,790

داده ها را به 28 ردیف 28 پیکسلی مسطح می کنیم، در

77

00:02:43,790 –> 00:02:46,730

نهایت 784 پیکسل را یکی پس از

78

00:02:46,730 –> 00:02:47,840

دیگری به دست می آوریم و این چیزی که ما قرار است در آن

79

00:02:47,840 –> 00:02:49,489

به عنوان ورودی تغذیه کنیم به شبکه عصبی خود وارد

80

00:02:49,489 –> 00:02:51,920

کنید، به این معنی که

81

00:02:51,920 –> 00:02:53,360

لایه ورودی اولیه ما چیزی شبیه به

82

00:02:53,360 –> 00:02:55,220

این خواهد بود، ما یک دسته نورون خواهیم داشت

83

00:02:55,220 –> 00:02:57,800

و آنها تا انتها پایین می روند، بنابراین

84

00:02:57,800 –> 00:03:00,380

ما 784 نورون خواهیم داشت، بنابراین بیایید

85

00:03:00,380 –> 00:03:04,130

این را بگوییم است 7 8 4 من می دانم که شما

86

00:03:04,130 –> 00:03:05,480

احتمالاً به سختی می توانید آن را بخوانید

87

00:03:05,480 –> 00:03:07,840

اما نکته را متوجه شدید و این لایه ورودی ما است

88

00:03:07,840 –> 00:03:10,489

اکنون قبل از اینکه حتی در مورد هر

89

00:03:10,489 –> 00:03:12,170

نوع لایه پنهان صحبت کنیم، اجازه دهید در مورد لایه خروجی خود صحبت کنیم

90

00:03:12,170 –> 00:03:14,900

تا خروجی ما چیست خوب

91

00:03:14,900 –> 00:03:16,910

خروجی ما می تواند باشد. عددی بین

92

00:03:16,910 –> 00:03:18,230

0 و 9 باشید، در

93

00:03:18,230 –> 00:03:20,120

حالت ایده آل، این چیزی است که ما می خواهیم، بنابراین کا

94

00:03:20,120 –> 00:03:21,320

ی که در واقع برای لایه خروجی خود انجام می دهیم ای

95

00:03:21,320 –> 00:03:22,850

است که فقط یک نو

96

00:03:22,850 –> 00:03:24,400

ون داشته باشیم که در آخ

97

00:03:24,400 –> 00:03:26,900

ین دو ویدیوی قبل به عنوان مثال از آن استفاده می

98

00:03:26,900 –> 00:03:28,940

نیم. در واقع 10 نورون خواهیم داشت که

99

00:03:28,940 –> 00:03:31,730

هر کدام یکی از این

100

00:03:31,730 –> 00:03:33,709

کلاس های مختلف را نشان می دهد، بنابراین ما 0 تا

101

00:03:33,709 –> 00:03:34,130

9 داریم،

102

00:03:34,130 –> 00:03:37,370

بنابراین واضح است که 10 نورون یا 10 کلاس داریم، بنابراین

103

00:03:37,370 –> 00:03:41,840

بیایید 10 نورون داشته باشیم، بنابراین 1 2 3 4 5 6 7 8

104

00:03:41,840 –> 00:03:45,620

9 10 حالا با این نورون ها چه اتفاقی می افتد.

105

00:03:45,620 –> 00:03:48,019

آیا هر یک از آنها قرار

106

00:03:48,019 –> 00:03:50,090

است یک مقدار و t داشته باشد ارزش کلاه

107

00:03:50,090 –> 00:03:52,600

نشاندهنده این است که شبکه چقدر فکر میکند

108

00:03:52,600 –> 00:03:55,790

که هر یک از نورونها هستند، بهعنوان مثال

109

00:03:55,790 –> 00:03:58,760

بگوییم که ما تصویری را که

110

00:03:58,760 –> 00:04:00,590

شبیه یک تیشرت یا شاید شبیه یک

111

00:04:00,590 –> 00:04:01,940

شلوار است طبقهبندی میکنیم، بنابراین ترسیم آنها بسیار آسان است،

112

00:04:01,940 –> 00:04:03,440

بنابراین بیایید این را بگوییم. این تصویری است

113

00:04:03,440 –> 00:04:04,730

که به ما یک شلوار کوچک داده میشود،

114

00:04:04,730 –> 00:04:07,400

چه اتفاقی میافتد

115

00:04:07,400 –> 00:04:09,170

این است که بگوییم شلوار شبیه به این است.

116

00:04:09,170 –> 00:04:11,420

117

00:04:11,420 –> 00:04:13,880

118

00:04:13,880 –> 00:04:16,700

ما فکر می کنیم 0.05

119

00:04:16,700 –> 00:04:19,430

درصد است، ما تا حدی از

120

00:04:19,430 –> 00:04:21,410

اطمینان داریم که این 10 درصد است

121

00:04:21,410 –> 00:04:24,320

و بعد مثل این است که فکر می کنیم 75

122

00:04:24,320 –> 00:04:25,130

درصد شلوار است،

123

00:04:25,130 –> 00:04:27,050

بنابراین وقتی به

124

00:04:27,050 –> 00:04:28,670

این لایه خروجی نگاه می کنیم، اساساً

125

00:04:28,670 –> 00:04:31,040

چه کاری انجام می دهیم. بزرگترین است بنابراین

126

00:04:31,040 –> 00:04:32,780

هر احتمالی که بیشترین است و

127

00:04:32,780 –> 00:04:34,430

سپس بگویید این همان چیزی است که شبکه

128

00:04:34,430 –> 00:04:37,550

پیشبینی میکند کلاس شی داده شده

129

00:04:37,550 –> 00:04:39,830

است، بنابراین وقتی

130

00:04:39,830 –> 00:04:41,510

شبکه را آموزش میدهیم، اساساً کاری که انجام

131

00:04:41,510 –> 00:04:44,150

میدهیم این است که بگوییم خوب است. دوباره

132

00:04:44,150 –> 00:04:46,550

شلوار را می دهیم تا بدانیم اینکه این یکی باید

133

00:04:46,550 –> 00:04:48,020

درست باشه این باید صد در

134

00:04:48,020 –> 00:04:50,510

صد باشه باید یکی باشه که

135

00:04:50,510 –> 00:04:51,470

باید باشه و این یکی دیگه

136

00:04:51,470 –> 00:04:53,810

باید صفر باشه چون

137

00:04:53,810 –> 00:04:55,130

شانسش صفر درصد باشه که حرف دیگه ای

138

00:04:55,130 –> 00:04:56,930

بزنه چون میدونیم شلواره

139

00:04:56,930 –> 00:04:58,550

و سپس شبکه به همه اینها نگاه میکند

140

00:04:58,550 –> 00:05:00,050

و همه وزنها و

141

00:05:00,050 –> 00:05:02,480

سوگیریها را بر اساس آن تنظیم میکند تا ما آن را به گونهای دریافت کنیم

142

00:05:02,480 –> 00:05:04,520

که این یکی را مستقیماً به عنوان

143

00:05:04,520 –> 00:05:06,800

یکی روشن کند، حداقل هدف ما درست همین است، بنابراین

144

00:05:06,800 –> 00:05:09,230

وقتی این کار را انجام دادیم، بنابراین اکنون با آن صحبت کردهایم.

145

00:05:09,230 –> 00:05:11,030

لایه ورودی و لایه خروجی اکنون

146

00:05:11,030 –> 00:05:12,590

زمان آن است که در مورد لایه های مخفی خود صحبت کنیم

147

00:05:12,590 –> 00:05:15,170

تا بتوانیم

148

00:05:15,170 –> 00:05:17,480

شبکه ای را آموزش دهیم که فقط دو لایه

149

00:05:17,480 –> 00:05:18,770

باشد و ما فقط همه این ورودی ها را داریم

150

00:05:18,770 –> 00:05:20,810

که به نوعی از خروجی ها می روند اما

151

00:05:20,810 –> 00:05:23,060

واقعاً اینطور نیست. کارهای زیادی برای ما انجام دهید زیرا

152

00:05:23,060 –> 00:05:24,320

اساساً این بدان معناست که ما

153

00:05:24,320 –> 00:05:25,730

فقط به تمام پیکسل ها نگاه می کنیم و

154

00:05:25,730 –> 00:05:28,100

بر اساس آن پیکربندی پیکسل

155

00:05:28,100 –> 00:05:30,500

ها به شما اشاره می کند که این لایه های خروجی را می شناسید

156

00:05:30,500 –> 00:05:31,940

و این بدان معنی است که ما فقط همان چیزی را خواهیم

157

00:05:31,940 –> 00:05:35,090

داشت که می دانم به نظر می رسد. فقط 784

158

00:05:35,090 –> 00:05:38,270

ضربدر 10 وزن و سوگیری بنابراین 784 ضربدر

159

00:05:38,270 –> 00:05:39,710

10 به این معنی است که ما

160

00:05:39,710 –> 00:05:43,490

فقط 7840 وزن را

161

00:05:43,490 –> 00:05:46,580

داریم که

162

00:05:46,580 –> 00:05:47,870

باید به آنها توجه کنیم.

163

00:05:47,870 –> 00:05:50,960

میتوانید

164

00:05:50,960 –> 00:05:53,270

165

00:05:53,270 –> 00:05:55,190

بهطور خودسرانه تعداد نورونهای خود را در

166

00:05:55,190 –> 00:05:56,900

لایه پنهان خود انتخاب کنید، ایده خوبی است

167

00:05:56,900 –> 00:05:58,820

که بر اساس درصدهایی از لایه ورودی خود خاموش شوید،

168

00:05:58,820 –> 00:06:00,830

اما چیزی که ما میخواهیم داشته

169

00:06:00,830 –> 00:06:03,050

باشیم این است که یک لایه مخفی خواهیم داشت. لایه و در

170

00:06:03,050 –> 00:06:04,550

این مورد این لایه

171

00:06:04,550 –> 00:06:06,380

پنهان صد و بیست و هشت نورون خواهد داشت،

172

00:06:06,380 –> 00:06:09,530

بنابراین ما می گوییم این 128 است و این

173

00:06:09,530 –> 00:06:12,110

به عنوان لایه پنهان ما شناخته می شود، بنابراین آنچه

174

00:06:12,110 –> 00:06:13,340

اکنون اتفاق می افتد این است که

175

00:06:13,340 –> 00:06:16,040

ورودی های خود را به لایه پنهان متصل می کنیم. لایه به

176

00:06:16,040 –> 00:06:18,080

طور کامل متصل می شود و سپس لایه پنهان

177

00:06:18,080 –> 00:06:19,880

به همه نورون های خروجی ما متصل می شود که به

178

00:06:19,880 –> 00:06:21,860

179

00:06:21,860 –> 00:06:24,710

پیچیدگی بسیار بیشتر شبکه

180

00:06:24,710 –> 00:06:27,050

ما اجازه می دهد زیرا ما تعداد زیادی بایاس و

181

00:06:27,050 –> 00:06:28,490

وزن های بیشتری را به این لایه میانی متصل خواهیم کرد

182

00:06:28,490 –> 00:06:30,320

که شاید به خوبی می شود قادر

183

00:06:30,320 –> 00:06:32,180

به کشف الگوهایی مانند شاید

184

00:06:32,180 –> 00:06:34,760

به دنبال یک خط مستقیم که

185

00:06:34,760 –> 00:06:36,290

شبیه یک آستین شلوار است، شبیه

186

00:06:36,290 –> 00:06:38,880

یک آستین بازو است، شاید آنها به دنبال

187

00:06:38,880 –> 00:06:40,920

تمرکز یک منطقه خاص در

188

00:06:40,920 –> 00:06:42,420

تصویر باشند و این همان چیزی است که ما

189

00:06:42,420 –> 00:06:44,550

امیدواریم که لایه پنهان ما شاید

190

00:06:44,550 –> 00:06:46,980

بتواند برای ما انجام دهد، شاید

191

00:06:46,980 –> 00:06:48,870

برخی از الگوها را انتخاب کنیم و سپس

192

00:06:48,870 –> 00:06:50,970

شاید با این ترکیبی از الگوها

193

00:06:50,970 –> 00:06:54,300

بتوانیم تشخیص دهیم که واقعاً چه تصویر خاصی

194

00:06:54,300 –> 00:06:56,280

است، اکنون واقعاً نمی دانیم

195

00:06:56,280 –> 00:06:58,650

که شبکه پنهان چیست یا لایه مخفی

196

00:06:58,650 –> 00:07:00,300

درست می شود، ما به نوعی به آن

197

00:07:00,300 –> 00:07:03,060

امیدوار هستیم و با انتخاب 128 نورون

198

00:07:03,060 –> 00:07:04,710

می گوییم خوب است، به

199

00:07:04,710 –> 00:07:06,840

این لایه Hinn اجازه می دهیم

200

00:07:06,840 –> 00:07:08,840

راه خود را پیدا کند و راهی برای

201

00:07:08,840 –> 00:07:11,850

تجزیه و تحلیل این موضوع پیدا کند. تصویر و سپس این

202

00:07:11,850 –> 00:07:13,830

اساساً کاری است که ما انجام خواهیم داد، بنابراین اگر

203

00:07:13,830 –> 00:07:14,970

در مورد آن سؤالی دارید، لطفاً

204

00:07:14,970 –> 00:07:17,640

در پرسیدن دریغ نکنید، اما

205

00:07:17,640 –> 00:07:19,920

لایههای مخفی کاملاً خودسرانه هستند، متأسفم

206

00:07:19,920 –> 00:07:21,840

که قلمم را انداختم، یعنی میدانید

207

00:07:21,840 –> 00:07:23,400

که میتوانید با آنها آزمایش کنید.

208

00:07:23,400 –> 00:07:25,350

یک نوع نیشگون گرفتن با آنها وجود دارد که برخی از

209

00:07:25,350 –> 00:07:27,360

آنها به خوبی انجام می دهند، اما

210

00:07:27,360 –> 00:07:28,680

معمولاً وقتی یک

211

00:07:28,680 –> 00:07:31,020

لایه مخفی را انتخاب می کنید، یکی را انتخاب می کنید و معمولاً

212

00:07:31,020 –> 00:07:33,240

15 تا 20 درصد از اندازه ورودی را پیش می برید،

213

00:07:33,240 –> 00:07:35,010

اما باز هم واقعاً به این بستگی دارد.

214

00:07:35,010 –> 00:07:37,710

برنامهای که شما از آن استفاده میکنید، پس

215

00:07:37,710 –> 00:07:39,870

بیایید اکنون کار

216

00:07:39,870 –> 00:07:43,290

با دادههای خود و ایجاد یک مدل را شروع

217

00:07:43,290 –> 00:07:44,820

کنیم، بنابراین اگر میخواهیم یک مدل ایجاد کنیم، اولین

218

00:07:44,820 –> 00:07:46,920

کاری که باید انجام دهیم این است که

219

00:07:46,920 –> 00:07:48,780

معماری یا لایههای مدل خود را تعریف کنیم

220

00:07:48,780 –> 00:07:50,370

و این کاری است که ما انجام دادهایم، بنابراین

221

00:07:50,370 –> 00:07:51,600

من میخواهم آن را به سرعت در اینجا تایپ کنم

222

00:07:51,600 –> 00:07:53,670

و دوباره شما بچهها خواهید دید که چگونه

223

00:07:53,670 –> 00:07:56,280

کار میکند، بنابراین میخواهم بگویم مدل در این مورد برابر است با

224

00:07:56,280 –> 00:07:59,940

ترتیب نقطهای کارا باور کنید

225

00:07:59,940 –> 00:08:01,110

که چگونه آن را املا میکنید

226

00:08:01,110 –> 00:08:03,090

و سپس چه ما این کار را انجام می دهیم این است که در

227

00:08:03,090 –> 00:08:04,770

اینجا لیستی قرار دهیم و ما شروع به

228

00:08:04,770 –> 00:08:06,540

تعریف لایه های مختلف

229

00:08:06,540 –> 00:08:10,020

برنامه های مراقبت جانبی Syrena لایه های نقطه ای می کنیم و

230

00:08:10,020 –> 00:08:11,820

اولین لایه ما یک لایه ورودی است

231

00:08:11,820 –> 00:08:13,980

اما یک لایه ورودی صاف

232

00:08:13,980 –> 00:08:17,010

و شکل زیر خط ورودی خواهد بود.

233

00:08:17,010 –> 00:08:20,070

برابر 28 در 28 خواهد بود بنابراین به یاد داشته باشید که من

234

00:08:20,070 –> 00:08:21,750

در مورد آن صحبت کردم که در ابتدا کاری که ما باید

235

00:08:21,750 –> 00:08:23,700

انجام دهیم این است که باید داده های خود را صاف

236

00:08:23,700 –> 00:08:27,210

کنیم تا برای همه آن نورون های مختلف قابل انتقال باشد،

237

00:08:27,210 –> 00:08:29,580

بنابراین اساساً من

238

00:08:29,580 –> 00:08:31,710

شکل درست را اشتباه املایی کردم،

239

00:08:31,710 –> 00:08:33,360

بنابراین اساساً هر زمان که شما

240

00:08:33,360 –> 00:08:34,799

اطلاعاتی را ارسال می کنید. مانند یک

241

00:08:34,799 –> 00:08:37,289

آرایه 2 بعدی یا 3 بعدی، باید آن اطلاعات را صاف کنید

242

00:08:37,289 –> 00:08:38,969

تا بتوانید

243

00:08:38,969 –> 00:08:40,950

آن را به یک نورون جداگانه

244

00:08:40,950 –> 00:08:42,840

ارسال کنید، در مقابل ارسال یک لیست کامل

245

00:08:42,840 –> 00:08:45,540

به یک نورون در حال حاضر لایه بعدی

246

00:08:45,540 –> 00:08:4