در این مطلب، ویدئو PyTorch Lightning Tutorial – PyTorch Wrapper سبک برای محققان ML با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:28:02

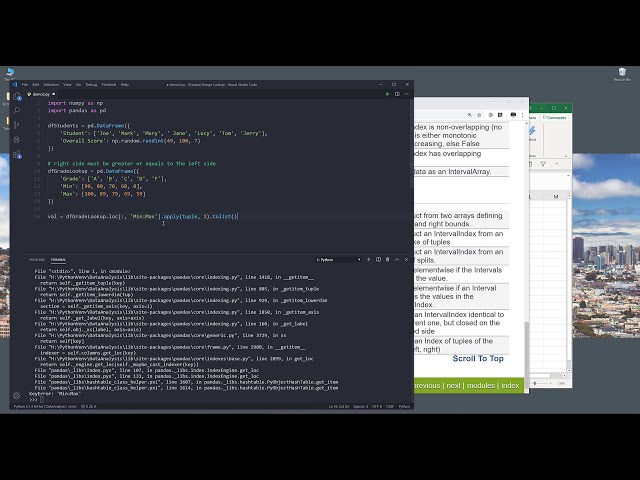

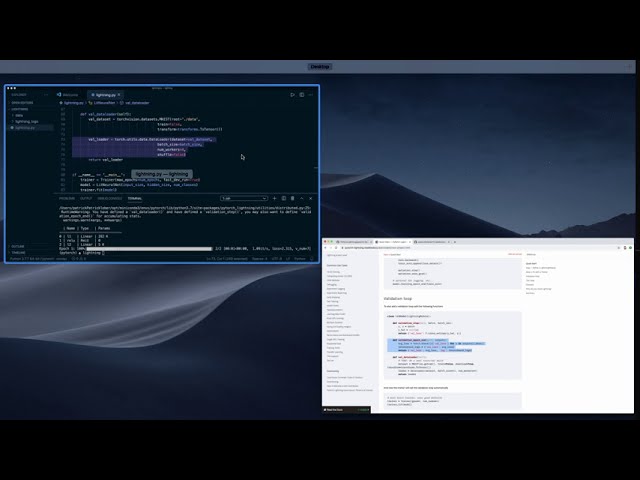

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:00,080 –> 00:00:01,920

سلام بچه ها به آموزش نمودارهای دایره ای جدید خود خوش آمدید،

2

00:00:01,920 –> 00:00:04,160

امروز در مورد

3

00:00:04,160 –> 00:00:05,920

مشعل پای

4

00:00:05,920 –> 00:00:07,680

لایتنینگ پای شارژ

5

00:00:07,680 –> 00:00:08,960

6

00:00:08,960 –> 00:00:11,200

7

00:00:11,200 –> 00:00:12,960

8

00:00:12,960 –> 00:00:15,200

9

00:00:15,200 –> 00:00:17,359

صحبت خواهیم کرد. خیلی

10

00:00:17,359 –> 00:00:18,720

11

00:00:18,720 –> 00:00:20,880

سریعتر لازم نیست تمام

12

00:00:20,880 –> 00:00:23,119

جزئیات ریز چارچوب پایتورچ را

13

00:00:23,119 –> 00:00:26,080

به خاطر بسپارید، زیرا لایتنینگ از همه اینها مراقبت میکند

14

00:00:26,080 –> 00:00:28,000

و یکی دیگر از ویژگیهای عالی این است که

15

00:00:28,000 –> 00:00:29,679

هشدارها را چاپ میکند و در صورت اشتباه،

16

00:00:29,679 –> 00:00:31,840

نکات یا نکات یادگیری ماشینی مفیدی را به شما ارائه میدهد،

17

00:00:31,840 –> 00:00:34,000

بنابراین ما این کار را انجام خواهیم داد.

18

00:00:34,000 –> 00:00:37,120

همه اینها را بعداً ببینید، بنابراین معمولاً در مورد

19

00:00:37,120 –> 00:00:39,120

فریمورکهای بسته بندی که

20

00:00:39,120 –> 00:00:41,120

خیلی چیزها را انتزاعی میکنند شک دارم،

21

00:00:41,120 –> 00:00:43,760

اما این بار واقعاً میتوانم آن را توصیه

22

00:00:43,760 –> 00:00:45,520

کنم، همچنان توصیه میکنم

23

00:00:45,520 –> 00:00:48,079

که ابتدا اصول اساسی را یاد بگیرید و

24

00:00:48,079 –> 00:00:49,920

اگر هنوز این کار را نکردهاید، پس شما می توانید

25

00:00:49,920 –> 00:00:52,559

دوره رایگان پایتورچ من را در اینجا در یوتیوب

26

00:00:52,559 –> 00:00:54,960

بررسی کنید، پیوند در توضیحات موجود است، اما

27

00:00:54,960 –> 00:00:57,280

اگر قبلاً با پایتورچ آشنا

28

00:00:57,280 –> 00:00:59,520

هستید، می توانید پایتورچ لایتنینگ را بررسی کنید.

29

00:00:59,520 –> 00:01:01,359

و ببینید آیا آن را دوست دارید یا نه

30

00:01:01,359 –> 00:01:03,760

پس امروز یکی

31

00:01:03,760 –> 00:01:05,760

از کدهای دوره پایتورچ خود را

32

00:01:05,760 –> 00:01:08,720

به پایتورچ لایتنینگ تبدیل می کنم تا بتوانید

33

00:01:08,720 –> 00:01:10,880

احساس کنید این فریم ورک چگونه کار می کند و

34

00:01:10,880 –> 00:01:13,040

چگونه می توانید از آن استفاده کنید، اجازه دهید

35

00:01:13,040 –> 00:01:13,920

36

00:01:13,920 –> 00:01:16,560

ابتدا وارد آن شویم. از همه pi touch lightning

37

00:01:16,560 –> 00:01:17,439

منبع باز است،

38

00:01:17,439 –> 00:01:20,240

بنابراین می توانید آن را در اینجا در github پیدا کنید و

39

00:01:20,240 –> 00:01:21,360

آنها همچنین یک

40

00:01:21,360 –> 00:01:24,000

وب سایت با مستندات خوبی دارند که

41

00:01:24,000 –> 00:01:25,200

باید شما را شروع کند،

42

00:01:25,200 –> 00:01:26,960

من پیوندها را در توضیحات نیز قرار خواهم

43

00:01:26,960 –> 00:01:29,200

داد و اکنون در اینجا برخی از

44

00:01:29,200 –> 00:01:31,600

جزئیات وجود دارد که دیگر لازم نیست در

45

00:01:31,600 –> 00:01:33,680

مورد رعد و برق پایتورچ نگران باشید،

46

00:01:33,680 –> 00:01:35,920

بنابراین دیگر لازم نیست نگران این باشید

47

00:01:35,920 –> 00:01:37,680

که چه زمانی مدل خود را روی

48

00:01:37,680 –> 00:01:40,799

حالت آموزش یا ارزیابی قرار دهید، لازم نیست

49

00:01:40,799 –> 00:01:41,840

50

00:01:41,840 –> 00:01:45,520

نگران استفاده از دستگاهی برای

51

00:01:45,520 –> 00:01:48,399

پشتیبانی از gpu باشید و سپس مدل خود را فشار

52

00:01:48,399 –> 00:01:50,640

دهید. تانسورهای دستگاه

53

00:01:50,640 –> 00:01:53,680

شما به راحتی می توانید پشتیبانی gpu یا حتی

54

00:01:53,680 –> 00:01:56,640

tpu را با رعد و برق خاموش کنید و

55

00:01:56,640 –> 00:01:58,640

به راحتی می توانید آن را افزایش دهید،

56

00:01:58,640 –> 00:02:00,880

سپس دیگر به

57

00:02:00,880 –> 00:02:01,840

58

00:02:01,840 –> 00:02:04,399

صفر درجه یا تماس به عقب اهمیتی نمی دهید و

59

00:02:04,399 –> 00:02:06,159

مرحله ای را بهینه

60

00:02:06,159 –> 00:02:09,119

کنید که دیگر نگران آن نباشید. استفاده از

61

00:02:09,119 –> 00:02:09,758

مشعل

62

00:02:09,758 –> 00:02:14,239

بدون گرفتن یا جدا کردن

63

00:02:14,239 –> 00:02:14,560

64

00:02:14,560 –> 00:02:17,599

65

00:02:17,599 –> 00:02:20,720

66

00:02:20,720 –> 00:02:22,560

67

00:02:22,560 –> 00:02:25,440

68

00:02:25,440 –> 00:02:26,400

69

00:02:26,400 –> 00:02:29,040

70

00:02:29,040 –> 00:02:31,760

آموزش، بنابراین شما می توانید آن را در github پیدا کنید

71

00:02:31,760 –> 00:02:34,879

و سپس در این مورد، آموزش شماره 13 را می گیریم،

72

00:02:34,879 –> 00:02:38,000

بنابراین این یک

73

00:02:38,000 –> 00:02:41,200

شبکه عصبی پیشروی ساده است که

74

00:02:41,200 –> 00:02:42,640

75

00:02:42,640 –> 00:02:46,560

برای انجام طبقه بندی رقم به مجموعه داده های mnist اعمال می شود،

76

00:02:46,560 –> 00:02:50,080

بنابراین اکنون اجازه دهید مقداری از کد را برداریم و یک کد

77

00:02:50,080 –> 00:02:50,480

بنویسیم.

78

00:02:50,480 –> 00:02:54,160

کد جدید با پایتورچ لایتنینگ

79

00:02:54,160 –> 00:02:57,840

پس اول از همه پس اجازه دهید این را حذف کنم

80

00:02:57,840 –> 00:03:00,800

و حالا با یک اسکریپت پایتون جدید شروع

81

00:03:00,800 –> 00:03:02,879

82

00:03:02,879 –> 00:03:05,200

می کنیم و اتفاقاً وقتی می خواهید پایتورچ لایتنینگ را نصب کنید

83

00:03:05,200 –> 00:03:06,400

84

00:03:06,400 –> 00:03:09,440

دو گزینه رایج دارید که اولی

85

00:03:09,440 –> 00:03:09,920

استفاده از

86

00:03:09,920 –> 00:03:12,800

pip است بنابراین شما فقط بگویید pip install pytorch

87

00:03:12,800 –> 00:03:13,760

lightning

88

00:03:13,760 –> 00:03:16,080

یا اگر از conda استفاده میکنید، میتوانید

89

00:03:16,080 –> 00:03:17,360

این دستور را بگیرید،

90

00:03:17,360 –> 00:03:21,120

بنابراین من قبلاً این کار را در ترمینال خود انجام دادهام،

91

00:03:21,120 –> 00:03:22,959

بنابراین pi touch lightning قبلاً

92

00:03:22,959 –> 00:03:24,239

در اینجا نصب شده است،

93

00:03:24,239 –> 00:03:27,680

بنابراین بیایید به کد بازگردیم

94

00:03:27,680 –> 00:03:30,480

و مقداری از آن را کپی و جایگذاری کنیم. بنابراین ما

95

00:03:30,480 –> 00:03:32,080

میخواهیم تمام

96

00:03:32,080 –> 00:03:35,280

عبارات import یکسانی داشته باشیم و

97

00:03:35,280 –> 00:03:37,840

به عنوان یک افزودنی اکنون

98

00:03:37,840 –> 00:03:38,560

پیتورچ

99

00:03:38,560 –> 00:03:41,680

لایتنینگ را نیز وارد میکنیم، بنابراین میگوییم رعد و برق

100

00:03:41,680 –> 00:03:46,040

پی مشعل را با علامت زیر خط وارد کنید

101

00:03:46,040 –> 00:03:48,319

102

00:03:48,319 –> 00:03:52,080

و اکنون میخواهیم

103

00:03:52,080 –> 00:03:55,280

مدل خود را شبکه عصبی خود را به یک

104

00:03:55,280 –> 00:03:58,400

مدل رعد و برق تبدیل کنیم، بنابراین میگیریم.

105

00:03:58,400 –> 00:04:01,920

این کد و سپس

106

00:04:01,920 –> 00:04:05,040

آن را در اینجا کپی و پیست می کنیم

107

00:04:05,040 –> 00:04:09,080

و اکنون به جای استخراج از

108

00:04:09,080 –> 00:04:11,360

nn.module، اکنون

109

00:04:11,360 –> 00:04:14,799

از ماژول pl dot

110

00:04:14,799 –> 00:04:18,000

lightning استخراج می

111

00:04:18,000 –> 00:04:21,440

کنیم، این کارکردهای مشابه مدل اصلی

112

00:04:21,440 –> 00:04:24,240

را در اختیار ما قرار می دهد، اما تعدادی توابع دیگر را نیز به ما می

113

00:04:24,240 –> 00:04:24,960

دهد

114

00:04:24,960 –> 00:04:28,720

که ما آن را انجام می دهیم. در یک ثانیه خواهید دید، بنابراین اکنون

115

00:04:28,720 –> 00:04:31,600

تابع init همچنان یکسان است و

116

00:04:31,600 –> 00:04:33,600

تابع فوروارد نیز همچنان

117

00:04:33,600 –> 00:04:34,800

یکسان است،

118

00:04:34,800 –> 00:04:38,560

بنابراین ما به تمام پارامترهای hyper نیاز داریم،

119

00:04:38,560 –> 00:04:39,919

بنابراین بیایید آنها

120

00:04:39,919 –> 00:04:43,360

را نیز بگیریم، بنابراین بیایید

121

00:04:43,360 –> 00:04:46,880

این پارامترهای hyper را بگیریم و

122

00:04:46,880 –> 00:04:49,840

آنها را در اینجا و اکنون بچسبانیم. ما باید

123

00:04:49,840 –> 00:04:50,400

124

00:04:50,400 –> 00:04:53,919

چند توابع دیگر را پیاده سازی کنیم، بنابراین بیایید به سرعت

125

00:04:53,919 –> 00:04:55,280

به وب سایت رسمی برویم، به هر حال،

126

00:04:55,280 –> 00:04:58,160

127

00:04:58,160 –> 00:04:59,440

راهنمای گام به گام را

128

00:04:59,440 –> 00:05:02,080

می بینید و همچنین مقایسه خوبی دارید که چگونه

129

00:05:02,080 –> 00:05:03,280

130

00:05:03,280 –> 00:05:06,639

کد شارژ پای در مقابل پای مشعل لایت به نظر می رسد. ing

131

00:05:06,639 –> 00:05:10,320

و آنچه را انتزاع می کند، بنابراین

132

00:05:10,320 –> 00:05:13,360

همانطور که می بینید، ما همچنین باید

133

00:05:13,360 –> 00:05:17,440

یک مرحله آموزشی تعریف کنیم، یک تابع بهینه ساز پیکربندی

134

00:05:17,440 –> 00:05:18,000

135

00:05:18,000 –> 00:05:21,600

و یک بارگذار داده قطار، بنابراین بیایید

136

00:05:21,600 –> 00:05:22,560

همه اینها

137

00:05:22,560 –> 00:05:26,479

را اینجا و

138

00:05:26,479 –> 00:05:29,039

اکنون کپی کنیم تا با

139

00:05:29,039 –> 00:05:31,080

ساده ترین آنها شروع کنیم تا

140

00:05:31,080 –> 00:05:34,240

بهینه سازها را پیکربندی کنیم. در آنجا شما به

141

00:05:34,240 –> 00:05:37,360

سادگی بهینهسازیکنندهای را که ایجاد کردهاید قرار میدهید، بنابراین

142

00:05:37,360 –> 00:05:37,680

در

143

00:05:37,680 –> 00:05:40,880

اسکریپت اصلی ما

144

00:05:40,880 –> 00:05:41,919

بهینهساز را

145

00:05:41,919 –> 00:05:46,400

در اینجا راهاندازی میکنیم، بنابراین این بهینهساز اتمی است

146

00:05:46,400 –> 00:05:50,320

و سپس شما آن را برمیگردانید تا بتوانیم

147

00:05:50,320 –> 00:05:54,000

این یکی را در یک خط برگردانیم، بنابراین این

148

00:05:54,000 –> 00:05:57,280

بهینهساز ما بهینهساز اتمی ما خواهد بود. با

149

00:05:57,280 –> 00:05:59,280

نرخ یادگیری از پارامترهای هایپر خود

150

00:05:59,280 –> 00:06:00,960

151

00:06:00,960 –> 00:06:04,800

و سپس می خواهیم مرحله آموزشی را پیاده سازی کنیم،

152

00:06:04,800 –> 00:06:07,280

153

00:06:07,280 –> 00:06:10,319

بنابراین برای مرحله آموزش

154

00:06:10,319 –> 00:06:13,440

دقیقاً همان کاری را انجام می دهیم که در حلقه آموزشی خود انجام می

155

00:06:13,440 –> 00:06:16,560

دهیم و اکنون

156

00:06:16,560 –> 00:06:19,039

دیگر نیازی نیست نگران برنامه های خود باشیم.

157

00:06:19,039 –> 00:06:20,160

حلقه هایی

158

00:06:20,160 –> 00:06:23,680

در مورد بازکردن تصاویر و برچسب های ما

159

00:06:23,680 –> 00:06:26,880

و سپس در اینجا بهینه ساز

160

00:06:26,880 –> 00:06:28,319

صفر، عقب و

161

00:06:28,319 –> 00:06:31,600

گام را می گیرد، بنابراین ما به سادگی

162

00:06:31,600 –> 00:06:35,840

این قسمت را می گیریم

163

00:06:37,039 –> 00:06:41,120

و آن را در اینجا می چسبانیم و همانطور که

164

00:06:41,120 –> 00:06:44,000

در تابع مرحله آموزشی مشاهده می کنید، یک

165

00:06:44,000 –> 00:06:44,639

b می گیریم. atch

166

00:06:44,639 –> 00:06:48,080

و یک شاخص دسته ای، بنابراین

167

00:06:48,080 –> 00:06:52,240

دسته خود را به x و y باز می کنیم

168

00:06:52,240 –> 00:06:56,319

و سپس به من اجازه می دهیم کد را کپی کنم،

169

00:06:56,319 –> 00:06:59,360

بنابراین این

170

00:06:59,360 –> 00:07:02,479

اکنون تصاویر و

171

00:07:02,479 –> 00:07:05,680

برچسب های ما هستند و سپس باید تصاویر خود را تغییر شکل

172

00:07:05,680 –> 00:07:06,639

173

00:07:06,639 –> 00:07:09,440

دهیم و دیگر مجبور نیستیم آن را به دستگاه فشار دهیم.

174

00:07:09,440 –> 00:07:10,560

175

00:07:10,560 –> 00:07:14,880

ما همه آن چیزها را حذف می کنیم

176

00:07:14,880 –> 00:07:18,240

و سپس پاس رو به جلو را انجام می دهیم

177

00:07:18,240 –> 00:07:21,440

و در اینجا می توانیم در واقع از self

178

00:07:21,440 –> 00:07:25,280

استفاده کنیم زیرا در کلاس مدل خود هستیم

179

00:07:25,280 –> 00:07:28,639

و سپس معیار را اعمال می کنیم

180

00:07:28,639 –> 00:07:32,160

و در کد اصلی

181

00:07:32,160 –> 00:07:35,479

خود معیار را در اینجا به عنوان

182

00:07:35,479 –> 00:07:38,400

آنتروپی nn.cross تنظیم می کنیم. از دست دادن

183

00:07:38,400 –> 00:07:42,080

اما اگر از ماژول عملکردی استفاده کنیم می توانیم به جای آن از آن استفاده کنیم

184

00:07:42,080 –> 00:07:45,360

،

185

00:07:45,360 –> 00:07:49,280

بنابراین برای این می گوییم

186

00:07:49,280 –> 00:07:52,560

وارد کردن مشعل نقطه nn

187

00:07:52,560 –> 00:07:55,599

نقطه تابع کانال

188

00:07:55,599 –> 00:07:59,199

s f و سپس در اینجا

189

00:07:59,199 –> 00:08:04,000

می گوییم تلفات ما برابر است و اکنون می

190

00:08:04,000 –> 00:08:05,280

191

00:08:05,280 –> 00:08:08,319

192

00:08:08,319 –> 00:08:11,599

توانیم با خروجی های خود آنتروپی نقطه ای متقاطع را فراخوانی کنیم. برچسب ها

193

00:08:11,599 –> 00:08:15,120

و اینها همه چیز هستند و در حال

194

00:08:15,120 –> 00:08:18,400

حاضر فقط می خواهیم یک دیکشنری را با

195

00:08:18,400 –> 00:08:18,800

این

196

00:08:18,800 –> 00:08:22,479

ضرر برگردانیم، بنابراین pytorch lightning به این دیکشنری نیاز دارد

197

00:08:22,479 –> 00:08:23,520

198

00:08:23,520 –> 00:08:26,319

تا بتواند ضرر را در طول آموزش به شما نشان دهد

199

00:08:26,319 –> 00:08:28,000

200

00:08:28,000 –> 00:08:31,120

و این تمام چیزی است که ما در مرحله آموزشی خود نیاز داریم

201

00:08:31,120 –> 00:08:34,640

و سپس ما همچنین باید

202

00:08:34,640 –> 00:08:38,399

من تابع بارگذار داده قطار را تکمیل کنید،

203

00:08:38,399 –> 00:08:41,679

بنابراین کاری که میخواهیم در اینجا انجام دهیم این است که

204

00:08:41,679 –> 00:08:44,880

میخواهیم کاری را که در ابتدا انجام دادیم انجام دهیم،

205

00:08:44,880 –> 00:08:46,160

206

00:08:46,160 –> 00:08:49,440

مجموعه دادههای آموزشی و بارگذار دادههای آموزشی را راهاندازی میکنیم،

207

00:08:49,440 –> 00:08:50,640

208

00:08:50,640 –> 00:08:54,399

بنابراین اجازه دهید این را کپی کرده و ابتدا آن را در

209

00:08:54,399 –> 00:08:57,519

تابع اینجا قرار دهیم.

210

00:08:57,519 –> 00:09:00,800

مجموعه دادههای قطار ما، بنابراین

211

00:09:00,800 –> 00:09:03,920

این یکی است و

212

00:09:03,920 –> 00:09:07,360

سپس بارکننده داده قطار،

213

00:09:07,360 –> 00:09:12,640

بنابراین این یکی و سپس میخواهیم

214

00:09:12,640 –> 00:09:15,760

بارگذار داده قطار یا

215

00:09:15,760 –> 00:09:18,959

لودر قطار را برگردانیم و اکنون این تمام چیزی است که برای

216

00:09:18,959 –> 00:09:22,080

شروع یک آموزش نیاز داریم و اکنون کاری که میخواهیم

217

00:09:22,080 –> 00:09:23,600

انجام دهیم این است ما می گوییم

218

00:09:23,600 –> 00:09:28,160

اگر نام مساوی است

219

00:09:28,160 –> 00:09:31,600

خط اصلی اصلی است، پس

220

00:09:31,600 –> 00:09:35,519

باید یک لایتینگ ترینر راه اندازی کنیم،

221

00:09:35,519 –> 00:09:38,560

بنابراین برای این کار یک ترینر وارد می کنیم، بنابراین می گوییم

222

00:09:38,560 –> 00:09:38,959

223

00:09:38,959 –> 00:09:42,080

از ترینر واردات لایتنینگ پی مشعل

224

00:09:42,080 –> 00:09:46,560

، سپس می خواهیم یک ترینر راه اندازی کنیم

225

00:09:46,560 –> 00:09:50,640

، بنابراین در اینجا می گوییم ترینر

226

00:09:50,640 –> 00:09:54,160

ما برابر است با رعد و برق ما. مربی

227

00:09:54,160 –> 00:09:56,720

و در حال حاضر می توانم ترفندی را به شما نشان دهم

228

00:09:56,720 –> 00:09:58,000

که در طول توسعه بسیار مفید است،

229

00:09:58,000 –> 00:10:00,959

بنابراین شما می گویید defron سریع

230

00:10:00,959 –> 00:10:01,839

231

00:10:01,839 –> 00:10:04,880

برابر است با درست، این

232

00:10:04,880 –> 00:10:08,000

یک دسته از طریق آموزش اجرا می شود و همچنین

233

00:10:08,000 –> 00:10:09,920

از طریق اعتبارسنجی اگر

234

00:10:09,920 –> 00:10:11,519

مرحله اعتبار سنجی دارید

235

00:10:11,519 –> 00:10:14,320

و با این کار می توانید تست کنید اگر مدل شما

236

00:10:14,320 –> 00:10:15,519

کار می

237

00:10:15,519 –> 00:10:18,480

کند، اکنون ما نیز باید مدل های خود را تنظیم کنیم

238

00:10:18,480 –> 00:10:19,440

تا می گوییم

239

00:10:19,440 –> 00:10:22,800

مدل برابر است و

240

00:10:22,800 –> 00:10:26,160

بیایید این مدل روشن را صدا کنیم تا

241

00:10:26,160 –> 00:10:27,200

مشخص شود که

242

00:10:27,200 –> 00:10:30,640

این یک مدل رعد و برق است که

243

00:10:30,640 –> 00:10:34,000

شبکه عصبی بسیار روشن است و در اینجا می گوییم اجازه دهید

244

00:10:34,000 –> 00:10:37,680

شبکه عصبی با پارامتر hyper بنابراین

245

00:10:37,680 –> 00:10:38,640

به

246

00:10:38,640 –> 00:10:41,760

اندازه ورودی نیاز دارد، به اندازه پنهان

247

00:10:41,760 –> 00:10:44,959

نیاز دارد و به تعداد کلاس هایی نیاز دارد

248

00:10:44,959 –> 00:10:47,600

که همه ما در اینجا برای پارامترهای hyper خود داریم،

249

00:10:47,600 –> 00:10:49,200

250

00:10:49,200 –> 00:10:52,399

سپس باید آن را به ترینر خود متناسب کنیم

251

00:10:52,399 –> 00:10:55,600

، بنابراین می گوییم نقطه مربی متناسب

252

00:10:55,600 –> 00:10:59,680

با مدل ما است و اکنون می توانیم اجرا کنیم. آن را

253

00:10:59,680 –> 00:11:02,079

ببینید و ببینید آیا این کار می کند،

254

00:11:02,079 –> 00:11:05,760

بنابراین حالا بیایید به

255

00:11:05,760 –> 00:11:08,560

کنسول برویم و حالا بیایید این فایل را اجرا

256

00:11:08,560 –> 00:11:09,120

کنیم تا می گوییم

257

00:11:09,120 –> 00:11:13,760

python lightning dot pi

258

00:11:13,760 –> 00:11:16,320

در اینجا با یک خطا مواجه می شویم بنابراین البته من

259

00:11:16,320 –> 00:11:17,440

260

00:11:17,440 –> 00:11:20,800

شبکه عصبی روشن را تغییر نام دادم بنابراین باید بگویم

261

00:11:20,800 –> 00:11:23,839

lit neural net اینجا و اکنون

262

00:11:23,839 –> 00:11:27,120

دوباره آن را اجرا می کنیم

263

00:11:27,279 –> 00:11:29,600

و اکنون می بینیم که شروع می شود، بنابراین می بینیم

264

00:11:29,600 –> 00:11:30,640

که ما

265

00:11:30,640 –> 00:11:33,920

پشتیبانی از gpu نداریم، همچنین یک نمای کلی

266

00:11:33,920 –> 00:11:35,120

از

267

00:11:35,120 –> 00:11:38,640

لایه های مختلف و پارامترهای خود دریافت می

268

00:11:38,640 –> 00:11:40,320

کنیم، زیرا اولین باری که مجموعه داده را دانلود می کنم آن را اجرا می کنم

269

00:11:40,320 –> 00:11:42,560

270

00:11:42,560 –> 00:11:45,920

و سپس در

271

00:11:45,920 –> 00:11:49,279

اینجا آموزش است بنابراین آن را کار کرد، بنابراین فقط

272

00:11:49,279 –> 00:11:50,240

یک دسته انجام داد،

273

00:11:50,240 –> 00:11:54,160

زیرا ما اجرای سریع def را برابر با true قرار دادیم،

274

00:11:54,160 –> 00:11:56,800

بنابراین بیایید آن را پاک کنیم و یک بار دیگر آن را آزمایش کنیم،

275

00:11:56,800 –> 00:11:57,600

276

00:11:57,600 –> 00:12:00,720

بنابراین حالا دیگر نباید آن را دانلود کند

277

00:12:00,720 –> 00:12:04,160

و این خیلی سریعتر بود و

278

00:12:04,160 –> 00:12:07,360

حالا برای مثال در اینجا یک

279

00:12:07,360 –> 00:12:11,040

اخطار دریافت می کنیم. میگوید

280

00:12:11,040 –> 00:12:13,360

بارگذار دادههای قطار بارگذار داده

281

00:12:13,360 –> 00:12:15,360

کارگر زیادی ندارد که

282

00:12:15,360 –> 00:12:18,639

ممکن است یک گلوگاه باشد.

283

00:12:18,639 –> 00:12:19,600

284

00:12:19,600 –> 00:12:23,279

285

00:12:23,279 –> 00:12:25,680

286

00:12:25,680 –> 00:12:26,399

287

00:12:26,399 –> 00:12:29,680

288

00:12:29,680 –> 00:12:33,120

در

289

00:12:33,120 –> 00:12:37,040

بارگذار قطار ما نیز میتوانیم آرگومان

290

00:12:37,040 –> 00:12:40,160

num working برابر با

291

00:12:40,160 –> 00:12:43,760

چهار به آن بدهیم و حالا بیایید این را پاک کنیم

292

00:12:43,760 –> 00:12:46,959

و دوباره آن را اجرا کنیم

293

00:12:48,079 –> 00:12:52,079

و اکنون هشدار ما از بین رفته است، بنابراین اکنون

294

00:12:52,079 –> 00:12:54,720

در اینجا نمای کلی را میبینیم که اکنون فقط

295

00:12:54,720 –> 00:12:55,680

از یک

296

00:12:55,680 –> 00:12:59,360

دوره استفاده کردهایم و در اینجا ضرر داریم.

297

00:12:59,360 –> 00:13:02,160

بنابراین اگر میخواهید یک آموزش کامل داشته باشید،

298

00:13:02,160 –> 00:13:03,279

299

00:13:03,279 –> 00:13:07,600

میتوانیم به مربی خود

300

00:13:07,600 –> 00:13:10,800

آرگومان max epoch

301

00:13:10,800 –> 00:13:14,240

برابر و سپس تعداد دورههایی

302

00:13:14,240 –> 00:13:16,079

که num epoch را تعریف کردهایم به مربی خود بدهیم،

303

00:13:16,079 –> 00:13:19,680

بنابراین این یکی از

304

00:13:19,680 –> 00:13:23,519

پارامترهای hyper است و

305

00:13:23,519 –> 00:13:26,639

حالا بیایید دوباره آن را روی false قرار دهیم.

306

00:13:26,639 –> 00:13:27,680

این باید یک

307

00:13:27,680 –> 00:13:31,200

تمرین کامل انجام داد و حالا بیایید ببینیم آیا

308

00:13:31,200 –> 00:13:33,279

این کار می کند یا نه

309

00:13:33,279 –> 00:13:36,320

و اکنون باید

310

00:13:36,320 –> 00:13:39,839

حداکثر دوره طول بکشد متأسفم

311

00:13:39,839 –> 00:13:43,040

اکنون باید کمی بیشتر طول بکشد

312

00:13:43,040 –> 00:13:45,199

و بله می بینیم بنابراین یک نوار پیشرفت خوب دریافت می

313

00:13:45,199 –> 00:13:46,240

314

00:13:46,240 –> 00:13:49,440

کنیم و کارهای آموزشی خود را می بینیم و

315

00:13:49,440 –> 00:13:53,199

ضرر ما باید به آرامی انجام شود کاهش دهید، بنابراین

316

00:13:53,199 –> 00:13:56,880

این کار می