در این مطلب، ویدئو پوکمون داده کاوی با پایتون [دوره crash] با زیرنویس فارسی را برای دانلود قرار داده ام. شما میتوانید با پرداخت 15 هزار تومان ، این ویدیو به علاوه تمامی فیلم های سایت را دانلود کنید.اکثر فیلم های سایت به زبان انگلیسی می باشند. این ویدئو دارای زیرنویس فارسی ترجمه شده توسط هوش مصنوعی می باشد که میتوانید نمونه ای از آن را در قسمت پایانی این مطلب مشاهده کنید.

مدت زمان فیلم: 00:11:51

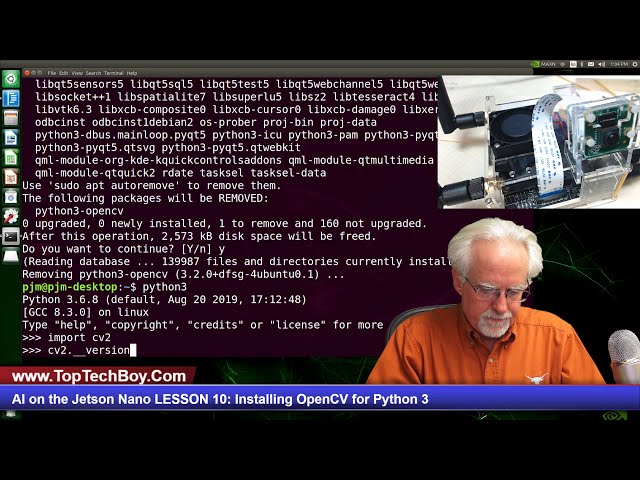

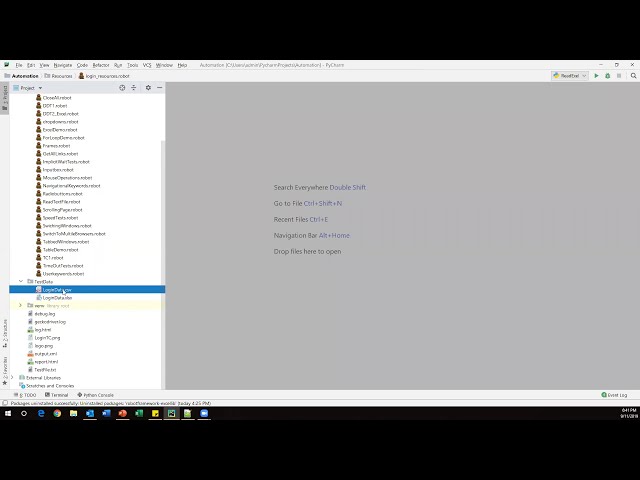

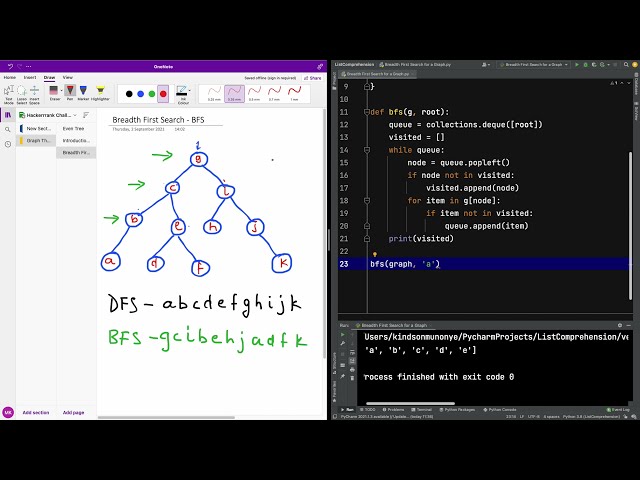

تصاویر این ویدئو:

قسمتی از زیرنویس این فیلم:

00:00:02,330 –> 00:00:06,810

در پایتون در پایان این

2

00:00:06,810 –> 00:00:09,510

ویدیو نه تنها یک قدم به

3

00:00:09,510 –> 00:00:12,809

استاد شدن در پوکمون نزدیکتر میشوید،

4

00:00:12,809 –> 00:00:16,379

بلکه اصول دادهکاوی را یاد میگیرید امروز میخواهیم

5

00:00:16,379 –> 00:00:18,119

6

00:00:18,119 –> 00:00:18,990

پوکمون pokédex

7

00:00:18,990 –> 00:00:21,060

را استخراج کنیم تا یک مدل یادگیری ماشین برای

8

00:00:21,060 –> 00:00:29,880

پیشبینی ادغام افسانهای ایجاد کنیم. وضعیت بیایید

9

00:00:29,880 –> 00:00:31,710

به این مجموعه داده نگاهی بیندازیم این یک

10

00:00:31,710 –> 00:00:35,460

فایل CSV است که من با استفاده از پانداها دانلود و وارد کردم،

11

00:00:35,460 –> 00:00:37,739

بنابراین مطمئناً باید پانداها را وارد کنیم

12

00:00:37,739 –> 00:00:41,309

زیرا P D D F برابر است با CSV نژاد P D

13

00:00:41,309 –> 00:00:45,629

Pokemon Z s B و D F

14

00:00:45,629 –> 00:00:48,329

که فریم داده ما است. ردیف

15

00:00:48,329 –> 00:00:51,539

یک پوکمون است که هر پوکمون یا سطر

16

00:00:51,539 –> 00:00:54,030

یک نمونه نامیده می شود در این قاب داده

17

00:00:54,030 –> 00:00:57,090

، متوجه خواهید شد که هر نمونه دارای 12

18

00:00:57,090 –> 00:01:00,149

ستون و یک متغیر نتیجه است

19

00:01:00,149 –> 00:01:01,890

که البته آخرین ستون به نام

20

00:01:01,890 –> 00:01:05,159

افسانه ای است، به عنوان مثال Bulbasaur یک

21

00:01:05,159 –> 00:01:07,439

نمونه در مجموعه داده ما است و grass

22

00:01:07,439 –> 00:01:10,350

ویژگی نوع یک Bulbasaur است، البته

23

00:01:10,350 –> 00:01:12,720

من میدانم که برخی از پوکمونها

24

00:01:12,720 –> 00:01:15,270

در انتشار آخرین بازی مانند

25

00:01:15,270 –> 00:01:18,560

دوست من Bulbasaur حذف شدهاند،

26

00:01:21,060 –> 00:01:24,720

اما ما از تمام پوکمونهایی

27

00:01:24,720 –> 00:01:27,390

که تاکنون استفاده شدهاند استفاده خواهیم کرد. منتشر شد و بله

28

00:01:27,390 –> 00:01:29,759

شامل این Pokemon بستنی عجیب و غریب

29

00:01:29,759 –> 00:01:32,909

و این بیش از حد کوچک است که باید

30

00:01:32,909 –> 00:01:35,220

صادقانه بگویم این Pokemon Beaver من را به یاد

31

00:01:35,220 –> 00:01:38,040

تب جاستین می اندازد اما این احتمالاً فقط

32

00:01:38,040 –> 00:01:40,200

به این دلیل است که دوایت شروت در دفتر

33

00:01:40,200 –> 00:01:42,450

فکر می کرد که جاستین بیبر در واقع

34

00:01:42,450 –> 00:01:45,090

بیش از حد عدالت یک بیش از حد مبارزه با جنایت است.

35

00:01:45,090 –> 00:01:46,520

این Justice Beaver

36

00:01:46,520 –> 00:01:49,610

[Music]

37

00:01:52,530 –> 00:01:55,620

Justice Sir

38

00:01:55,620 –> 00:01:58,439

[Music]

39

00:01:58,439 –> 00:02:00,840

برای ایجاد مدل پیش بینی خود باید

40

00:02:00,840 –> 00:02:03,179

تصمیم بگیریم که کدام ویژگی ها یا ستون ها

41

00:02:03,179 –> 00:02:05,219

واقعاً در پیش بینی

42

00:02:05,219 –> 00:02:07,259

نتیجه افسانه ای مفید هستند،

43

00:02:07,259 –> 00:02:09,750

تکنیک هایی برای تعیین اینکه کدام ویژگی ها

44

00:02:09,750 –> 00:02:12,000

واقعاً بر نتیجه تأثیر می گذارد وجود دارد، اما در این

45

00:02:12,000 –> 00:02:14,760

مورد ما فقط از عقل سلیم خود استفاده می کنیم

46

00:02:14,760 –> 00:02:18,150

، به عنوان مثال،

47

00:02:18,150 –> 00:02:20,519

نام پوکمون ها منحصر به فرد است که احتمالاً

48

00:02:20,519 –> 00:02:22,110

نمی تواند به ما بگوید که آیا

49

00:02:22,110 –> 00:02:24,299

آنها افسانه ای هستند یا نه، اما قدرت حمله و سایر

50

00:02:24,299 –> 00:02:27,120

آمارها ممکن است جالب تر باشد

51

00:02:27,120 –> 00:02:29,040

زیرا Legendary’s بسیار بالا شناخته شده است به این

52

00:02:29,040 –> 00:02:33,599

معنی که آمار آنها

53

00:02:33,599 –> 00:02:35,790

واقعا خوب است، بنابراین کل قدرت حمله

54

00:02:35,790 –> 00:02:38,459

قدرت دفاعی سرعت حمله ویژه

55

00:02:38,459 –> 00:02:41,310

همه اینها ممکن است وجود داشته باشد دیکتاتورها میگویند که

56

00:02:41,310 –> 00:02:43,410

ما یک افسانهای داریم، اما وقتی صحبت

57

00:02:43,410 –> 00:02:44,849

از تایپ

58

00:02:44,849 –> 00:02:47,310

شماره پوکمونها به میان میآید،

59

00:02:47,310 –> 00:02:48,840

فکر میکنم استدلالهای واضحی وجود

60

00:02:48,840 –> 00:02:51,239

دارد که چرا اگر یک

61

00:02:51,239 –> 00:02:53,280

پوکمون افسانهای باشد، بر اساس این

62

00:02:53,280 –> 00:02:54,840

دانش، ما میخواهیم خودمان را تقسیم کنیم. داده ها

63

00:02:54,840 –> 00:02:57,120

را در یک X و یک ساعت درست مانند

64

00:02:57,120 –> 00:02:59,700

عملکردهای ابتدایی که X را وصل می

65

00:02:59,700 –> 00:03:02,280

کنید، Y را خارج می کنید، بنابراین در مورد ما، مدل

66

00:03:02,280 –> 00:03:04,380

ما ویژگی هایی را که می خواهیم وصل می کند و

67

00:03:04,380 –> 00:03:07,349

ما افسانه ای می شویم یا نه، به همین دلیل است که

68

00:03:07,349 –> 00:03:08,849

X ویژگی های مورد استفاده در

69

00:03:08,849 –> 00:03:11,220

پیشبینی و Y نتیجهای خواهد بود که

70

00:03:11,220 –> 00:03:13,410

میخواهیم پیشبینی کنیم، بنابراین در کد ما انجام میدهیم

71

00:03:13,410 –> 00:03:17,130

X برابر است با ستونهای رها کردن DF برابر است

72

00:03:17,130 –> 00:03:19,410

با خلاص شدن از شر نام شماره نوع یک

73

00:03:19,410 –> 00:03:21,780

نوع دو افسانهای البته چون

74

00:03:21,780 –> 00:03:23,940

نتیجه و نسل ما این است. و

75

00:03:23,940 –> 00:03:26,310

برای Y این نتیجه ما است که

76

00:03:26,310 –> 00:03:28,560

میخواهیم پیشبینی کنیم، بنابراین فقط آن را به عنوان

77

00:03:28,560 –> 00:03:30,599

ستون افسانهای برای ایجاد مدل خود نگه

78

00:03:30,599 –> 00:03:32,819

میداریم، میخواهیم آن را بر روی دادههایمان آموزش دهیم، به

79

00:03:32,819 –> 00:03:35,010

عبارت دیگر ماشین ما قرار است

80

00:03:35,010 –> 00:03:38,239

دادهها را به صورت هوشمند یاد بگیرد. راه من در حال

81

00:03:38,239 –> 00:03:41,669

یادگیری و یک TE روش ارزیابی اثربخشی

82

00:03:41,669 –> 00:03:43,470

83

00:03:43,470 –> 00:03:45,840

الگوریتم یادگیری ماشین ما استفاده از

84

00:03:45,840 –> 00:03:49,349

تقسیم قطار آزمایشی است، در اینجا

85

00:03:49,349 –> 00:03:51,900

ما بخشی از داده های خود را برای اهداف آزمایشی حفظ می کنیم،

86

00:03:51,900 –> 00:03:53,910

به عنوان مثال فرض کنید تقسیم قطار آزمایشی ما

87

00:03:53,910 –> 00:03:57,629

در نسل 1 یا منطقه کانتو

88

00:03:57,629 –> 00:03:59,430

به معنای مدل ما است.

89

00:03:59,430 –> 00:04:02,340

روی تمام پوکمونهایی که در

90

00:04:02,340 –> 00:04:04,530

نسل 1 نیستند آموزش داده میشود، پس از اینکه دستگاه

91

00:04:04,530 –> 00:04:07,139

یاد گرفت، به آن نسل 1

92

00:04:07,139 –> 00:04:08,900

Pokemon میدهیم تا ببینیم

93

00:04:08,900 –> 00:04:11,090

واقعاً چقدر خوب عمل میکند، بنابراین فرض کنید وقتی

94

00:04:11,090 –> 00:04:13,519

مدلهای ما آموزش دیدند، ما به مدل دستگاه خود

95

00:04:13,519 –> 00:04:15,530

Pokemon Bulbasaur

96

00:04:15,530 –> 00:04:17,449

Bulbasaur را میدهیم. نمی دانم مربوط به

97

00:04:17,449 –> 00:04:19,910

نسل یک یا منطقه کانتو است،

98

00:04:19,910 –> 00:04:21,858

یعنی ماشین ما قبلا هرگز آن را ندیده است

99

00:04:21,858 –> 00:04:24,080

زیرا با استفاده از تمام

100

00:04:24,080 –> 00:04:26,300

نسل های دیگر آموزش داده شده است، مدل پیش بینی می کند

101

00:04:26,300 –> 00:04:28,910

که Bulbasaur افسانه ای است یا نه، اما ما

102

00:04:28,910 –> 00:04:30,050

از قبل می دانیم که پاسخ

103

00:04:30,050 –> 00:04:32,240

آن را می دانیم که Bulbasaur است. افسانه ای نیست،

104

00:04:32,240 –> 00:04:34,340

بنابراین می توانیم آنچه را که مدل به

105

00:04:34,340 –> 00:04:37,639

ما می دهد با پاسخ واقعی مقایسه کنیم.

106

00:04:37,639 –> 00:04:39,680

107

00:04:39,680 –> 00:04:42,080

108

00:04:42,080 –> 00:04:43,880

روش خوبی برای ارزیابی یک مدل یادگیری ماشینی است،

109

00:04:43,880 –> 00:04:46,250

اما در واقع تقسیم قطار آزمایشی ما

110

00:04:46,250 –> 00:04:48,470

در نسل 1 نخواهد بود، بلکه در

111

00:04:48,470 –> 00:04:50,360

واقع تصادفی خواهد بود و معمولاً

112

00:04:50,360 –> 00:04:52,699

این تقسیمبندی قطارهای آزمایشی حدود 60

113

00:04:52,699 –> 00:04:55,550

تا 40 درصد قطار برای آزمایش یا 70 تا 30 است.

114

00:04:55,550 –> 00:04:58,010

درصد تقسیم این واقعا آسان است برای

115

00:04:58,010 –> 00:04:59,990

پیاده سازی با scikit-learn و python

116

00:04:59,990 –> 00:05:02,600

ما از SK انجام می دهیم همه انتخاب

117

00:05:02,600 –> 00:05:04,639

واردات تست تقسیم قطار و ما یک

118

00:05:04,639 –> 00:05:07,160

کشیدگی گردن خواهیم داشت و X تست یک آموزش y

119

00:05:07,160 –> 00:05:09,800

تست Y برابر است با تقسیم تست قطار

120

00:05:09,800 –> 00:05:12,680

X ما مقادیر و مقدار Y ما اکنون که

121

00:05:12,680 –> 00:05:14,539

تقسیم قطار آزمایشی ما آماده است، ما آماده ایم

122

00:05:14,539 –> 00:05:17,120

که مدل خود را آموزش دهیم،

123

00:05:17,120 –> 00:05:19,580

مدل های یادگیری ماشین زیادی وجود دارد

124

00:05:19,580 –> 00:05:22,160

که می توانیم داده های خود را به آنها متصل کنیم و

125

00:05:22,160 –> 00:05:24,020

من توضیح نمی دهم که هر مدل خاصی چگونه

126

00:05:24,020 –> 00:05:26,150

کار می کند. از این ویدیو

127

00:05:26,150 –> 00:05:28,820

اما فعلاً در این ویدیو ما قصد داریم

128

00:05:28,820 –> 00:05:31,580

از چیزی به نام جنگل تصادفی

129

00:05:31,580 –> 00:05:34,340

130

00:05:34,340 –> 00:05:37,130

131

00:05:37,130 –> 00:05:39,320

132

00:05:39,320 –> 00:05:41,870

استفاده کنیم. ٪

133

00:05:41,870 –> 00:05:44,030

از همه از پوکمون ما وقتی

134

00:05:44,030 –> 00:05:45,830

این مدل را ایجاد می کنیم، کلیدواژه

135

00:05:45,830 –> 00:05:48,650

بوت استرپ برابر با واردات واقعی

136

00:05:48,650 –> 00:05:51,410

طبقه بندی کننده جنگل تصادفی به عنوان s ما است و

137

00:05:51,410 –> 00:05:54,680

ما مدل CLF برابر با RS را ایجاد می

138

00:05:54,680 –> 00:05:57,889

139

00:05:57,889 –> 00:06:01,090

کنیم.

140

00:06:01,090 –> 00:06:03,770

اکنون خیلی سریع یاد میگیرم، میخواهم به

141

00:06:03,770 –> 00:06:05,449

شما نشان دهم که یکی از این درختها واقعاً چه

142

00:06:05,449 –> 00:06:07,490

شکلی است، زیرا یکی از

143

00:06:07,490 –> 00:06:09,139

آنها را برای شما تجسم کردم در اینجا نمونهای از آنچه

144

00:06:09,139 –> 00:06:11,000

این کد در واقع ایجاد میکند است، بنابراین

145

00:06:11,000 –> 00:06:13,190

میبینید که این فقط یک درخت تصمیم است بر

146

00:06:13,190 –> 00:06:14,750

اساس ویژگیهایی که ما داریم. بنابراین در این

147

00:06:14,750

![فیلم آموزشی: Grid Bot [Part 3] - Python CCXT Backend Tutorial با زیرنویس فارسی](http://s1.program98.com/learn/wp-content/uploads/upyt/QzqMGX4Qk1Aimage2.jpg)

![فیلم آموزشی: Python [pygame] 09 Mouse Movement با زیرنویس فارسی](http://s1.program98.com/learn/wp-content/uploads/upyt/ruyRxyGOG0Uimage2.jpg)